그래프 구조 학습을 위한 스펙트럴 위치 인코딩 기반 GNN-Transformer 하이브리드 추천 모델

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

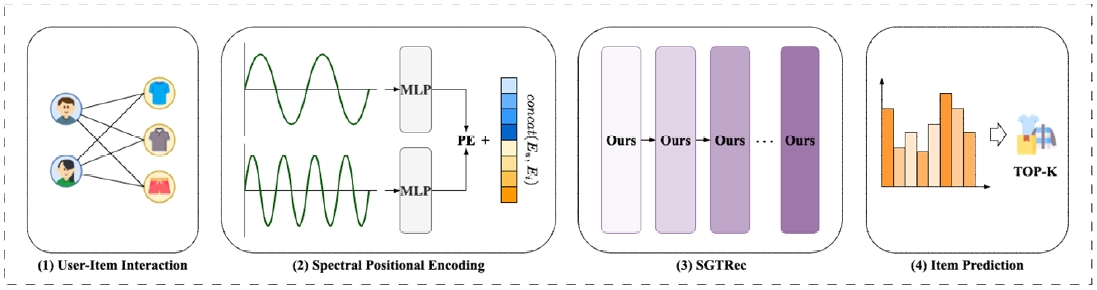

본 연구는 GNN의 지역적 전파와 Transformer의 전역 표현 학습을 결합한 하이브리드 추천 프레임워크를 제안한다. GNN은 이웃 집계로 구조적 정보를 학습하지만 전파 깊이의 제한으로 전역 관계 포착이 어렵고, Transformer는 자기-어텐션으로 장거리 의존성에 강점이 있으나 그래프 위상 반영이 약하다. 우리는 그래프 메시지 전달로 구조 신호를 쌓고, 사용자·아이템 임베딩을 Transformer 인코더로 정교화한다. 특히 라플라시안 고유벡터 기반 스펙트럴 위치 인코딩을 도입하여 저주파·고주파 성분을 함께 사용한다. 저주파는 커뮤니티 등 전역·매끄러운 패턴을, 고주파는 취향 급변·희소 상호작용·경계부같은 국소 변화를 포착해 상호 보완적으로 표현력을 강화한다. 다양한 공개 데이터셋에서 본 모델은 기존 방법 대비 일관된 성능 향상을 보였다. 전역·국소 신호를 반영해 오버스무딩을 줄이고 다중 스케일을 보존한다. 실험에서 Recall@K와 NDCG@K가 기존 방법론 대비 우수한 성능을 확인하였다.

Abstract

We propose a hybrid recommendation framework that marries the local message-passing strengths of graph neural networks (GNNs) with the global context modeling of Transformers. While GNNs effectively aggregate neighborhood structure, limited propagation depth hampers long-range reasoning; conversely, Transformers capture long-range dependencies via self-attention but do not natively encode graph topology. Our model first accumulates structural signals through graph-based message passing and then refines user and item representations with dedicated Transformer encoders. To inject topology, we introduce spectral positional encoding derived from Laplacian eigenvectors and jointly leverage low- and high-frequency components: low frequencies capture smooth, community-level structure, whereas high frequencies highlight abrupt, local variations such as sparse interactions and boundary effects. This dual-band design balances global and local cues, mitigating oversmoothing and preserving multi-scale information. Experiments on public benchmarks demonstrate consistent gains over strong baselines, with improvements in Recall@K and NDCG@K, validating the effectiveness and generality of the proposed approach.

Keywords:

Recommendation System, GNN, Transformer, Spectral EncodingⅠ. 서 론

사용자와 아이템 간 상호작용을 이용한 추천 시스템은 대규모 온라인 서비스의 핵심 구성 요소로 자리 잡았으며, 그래프 신경망(Graph Neural Networks, GNN)의 발전으로 관계 구조를 보다 정교하게 학습할 수 있게 되었다. GNN은 인접 노드의 표현을 반복적으로 집계(aggregation)하여 고차 이웃(high-order neighbors) 정보를 통합함으로써 추천 정확도를 향상시켜 왔다. 그러나 이러한 지역적 전파(local propagation)는 레이어가 깊어질수록 표현이 균질화되는 오버스무딩(oversmoothing)을 초래하고, 결과적으로 전역적 관계를 포착하는 데 한계를 드러낸다[1,2].

한편 Transformer는 자기-어텐션(self-attention) 메커니즘을 통해 장거리 의존성을 유연하게 모델링하는 데 강점을 보이며, 최근 그래프 분야로의 확장이 활발히 논의되고 있다. 그럼에도 불구하고, Transformer는 본질적으로 시퀀스 중심의 아키텍처이기 때문에 그래프의 위상(topology)과 연결 구조를 직접 부호화(encode)하는 데 취약하다는 한계를 지닌다[3,4]. 결과적으로, GNN은 전역 문맥을 충분히 전달하지 못하고, Transformer는 지역 구조 신호를 충분히 반영하지 못하는 상보적 약점을 가진다.

본 연구는 이러한 간극을 해소하기 위해 GNN의 구조적 메시지 전파와 Transformer의 전역 표현 학습을 결합한 하이브리드 추천 모델을 제안한다. 제안 모델은 (i) 그래프 기반 메시지 전달을 통해 다중 홉의 구조 신호를 집계하고, (ii) 사용자·아이템 임베딩을 전용 Transformer 인코더로 정교화하여 장거리 상호작용을 반영한다.

특히 우리는 그래프 라플라시안의 고유벡터를 이용한 스펙트럴 위치 인코딩(spectral positional encoding, SPE)을 도입한다. 본질적 차별점은 ‘이중 대역(dual-band)’ 설계에 있다. 기존 연구가 주로 저주파 성분(스무스한 커뮤니티 구조) 중심으로 위치 정보를 주입하거나, 거리 기반 또는 노드 중심성과 같은 방법을 사용해 전역 혼합을 수행하는 데 그쳤다면, 우리 모델은 저주파와 함께 고주파 성분(희소 상호작용·경계부·급격한 취향 변화)을 동시에 주입하여 전파 과정에서 사라지기 쉬운 고주파 단서를 초기 단계부터 보강한다[5]. 이때 SPE가 Transformer에 위상 좌표계를 제공하므로, 자기-어텐션은 단순 내용 유사도뿐 아니라 그래프 구조에 정렬된 전역 혼합을 수행하게 된다. 즉, (a) message passing의 저역 편향을 고주파 주입으로 상쇄하고, (b) Transformer의 구조 위상 정보 부재를 SPE로 보정하며, (c) 레이어 가중합으로 멀티스케일을 보존하는 3요소가 상호작용하여, 기존 GNN–Transformer 결합이 달성하지 못한 깊은 전파에서도 정보 이득 유지, 오버스무딩 완화, 다중 스케일 보존을 동시에 실현한다.

종합하면, 제안하는 하이브리드 설계는 지역 구조 신호(메시지 전파)와 전역 문맥(self-attention), 그리고 스펙트럼 기반 위치 정보(저·고주파)를 하나의 파이프라인에서 통합한다. 우리는 Yelp, Tmall 등 공개 데이터셋을 대상으로 한 실험을 통해, 본 모델이 GNN 또는 Transformer 단독 기반 방법에 비해 Recall@K 및 NDCG@K에서 일관되게 우수한 성능을 보임을 확인하였다. 이는 저·고주파 스펙트럴 인코딩을 통한 토폴로지 인식적 표현 강화와 GNN–Transformer 결합 구조가 실제 추천 시나리오에서 유의미한 성능 개선을 가져올 수 있음을 시사한다.

Ⅱ. 제안 방법

본 장에서는 제안하는 하이브리드 추천 모델의 전체 구조에 대해 설명한다. 제안된 모델은 GNN과 Transformer의 상호 보완적 구조를 바탕으로, 그래프 기반의 지역적 관계와 전역적 상호작용을 동시에 반영할 수 있도록 설계되었다. 또한, 그래프의 위상 정보를 포착하기 위해 라플라시안 행렬의 고유벡터를 스펙트럴 임베딩으로 활용하여 위치 인코딩(Positional Encoding)으로 통합하였다.

1. 초기 사용자/아이템 임베딩

본 모델은 사용자 집합 U와 아이템 집합 I 각각에 대해 학습 가능한 임베딩 행렬을 둔다.

| (1) |

를 정의하고, 두 임베딩을 연결(concatenate)하여 그래프 전체 노드에 대한 초기 표현을 구성한다.

| (2) |

이때 사용자와 아이템은 동일한 잠재 차원 d를 공유하므로, 초기 시점부터 두 영역의 정보가 같은 표현 공간에서 상호작용한다. 이러한 결합은 이후 단계의 메시지 전달(지역 구조 반영)과 Transformer 자기-어텐션(전역 문맥 반영) 과정에서 사용자·아이템 간 신호가 초기부터 자연스럽게 섞이며 보완되도록 돕는다. 또한 초기 표현은 뒤에서 소개할 스펙트럴 위치 인코딩의 기반이 된다.

2. 그래프 기반 메시지 전달

그 후, 인접 행렬을 기반으로 하는 메시지 전달(message passing) 연산을 통해 고차 이웃의 정보를 집계한다. 사용자–아이템 이분 그래프의 정규화 인접 행렬을 라 할 때, 각 레이어 l = 1,...,L에서 노드 임베딩은 이웃으로부터 신호를 받아 아래와 같이 업데이트된다[7].

| (3) |

각 레이어의 임베딩은 누적되어 마지막에 attention 기반 가중합으로 결합한다.

3. Transformer 기반 전역 표현 학습

GNN의 지역적 전파로 얻은 표현을 사용자 부분과 아이템 부분으로 나누어, 각각 Transformer 인코더로 한 번 더 정교화한다. 이 단계는 멀리 떨어진 노드들 간의 장거리 의존성을 반영해, 전파 단계에서 모인 지역 정보에 전역 문맥을 더해준다. Transformer는 멀티헤드 어텐션(Multi-head Attention)을 기반으로 하며, 다음과 같은 인코더 구조로 구성된다.

| (4) |

여기서 MSA는 Multi-Head Self-Attention, FFN은 피드포워드 네트워크, LN은 LayerNorm을 의미한다.

4. 스펙트럴 임베딩 기반 위치 인코딩

Transformer 구조에서의 전역 관계 학습은 강력하지만, 노드 간의 고유한 위상 구조를 반영하는 데에는 한계가 있다. 이를 보완하기 위해, 제안된 모델은 그래프 라플라시안 행렬의 고유벡터를 기반으로 한 스펙트럴 임베딩을 위치 인코딩으로 사용한다[6]. 정규화 라플라시안 로부터 고유벡터 를 추출하며, 이 벡터는 노드의 주파수 성분을 나타낸다. 작은 고유값에 대응하는 고유벡터들은 이웃 노드 간 값의 차이가 작아 전역적으로 매끄러운 변화를 담고, 큰 고유값에 대응하는 고유벡터들은 이웃 간 차이가 커 국소적으로 날카로운 변화를 담는다. 우리는 이 두 성질을 동시에 활용하기 위해, 저주파 고유벡터 묶음 Ulow와 고주파 고유벡터 묶음 Uhigh을 공통 임베딩 차원으로 투영한 뒤 가중 결합하여 스펙트럴 위치 인코딩을 구성한다:

| (5) |

β는 고주파의 기여도를 조절하는 학습 가능한 파라미터이다. 이렇게 얻은 PE를 식 (2)에 보조 신호로 더해 입력 임베딩으로 사용하므로 전역 구조(저주파)와 국소 변화(고주파)를 한 표현 안에서 균형 있게 결합한 임베딩을 형성한다.

| (6) |

5. 학습

모델은 쌍별(pairwise) 랭킹 최적화 관점에서 학습한다. 최종 사용자/아이템 임베딩을 , 라 하고, 사용자 u와 아이템 i의 점수를 s(u,i) = <uu, ii>로 정의한다. 각 관측 삼중항 (u,i+,i-)에 대해 BPR(Bayesian Personalized Ranking) 손실을 최소화한다:

| (7) |

여기서 는 시그모이드이고, i-는 전체 아이템 집합에서 온라인 무작위 샘플링으로 선택한다. 최적화는 Adam으로 수행하며, 추론 시에는 학습에 사용된 상호작용을 마스킹한 뒤 (u,i)로 전체 아이템을 전순위 평가하여 Top-K를 추천한다.

6. 계산 복잡도

- • N = |U| + |I| : 전체 노드 수, M = |ε| : 엣지 수, d : 임베딩 차원

- • Lmp : message passing depth, Lt: Transformer Layer 수, H: 헤드 수(dh = d/H)

- • k = klow + khigh : SPE에 사용하는 저·고주파 고유벡터 개수

- • 시간: 라플라시안에서 k개 고유벡터(저·고주파) 근사 추출 O(kM)

- • 메모리: 고유벡터 저장 O(Nk), 투영 파라미터 O(kd)

- • ※ 데이터셋이 고정될 때 1회 계산 후 재사용(학습·추론 루프에는 반복 부담 없음)

- • 학습

(SPE 투영 Nkd, message passing LmpMd, Transformer의 self-attention·투영)

Ⅲ. 실험 및 결과

본 장에서는 제안하는 하이브리드 추천 모델의 성능을 검증하기 위해 Yelp, Tmall 데이터셋에서 실험을 수행하고, 기존 대표 방법들과의 비교를 통해 모델의 효과를 입증한다.

1. 데이터셋

Yelp 데이터셋은 지역 상권/POI에 대한 사용자–아이템 상호작용으로 구성된 그래프이다. 노드는 사용자와 매장을, 엣지는 서비스 내 행동을 의미한다. 약 29,600명의 사용자와 24,000개의 아이템, 1,527,326건 상호작용이 포함되어 있으며, 전반적으로 여러 카테고리의 매장과 다양한 사용자 취향을 반영한다.

Tmall 데이터셋은 대형 이커머스 환경에서의 클릭/구매 중심 상호작용으로 이루어진 사용자–아이템 그래프이다. 노드는 사용자와 상품을, 엣지는 세션 내 행동 기록을 나타낸다. 약 47,900명의 사용자, 41,300개 아이템, 2,357,450건 상호작용을 포함하며, 상품군이 넓고 롱테일 분포가 뚜렷해 실제 쇼핑 시나리오를 잘 반영한다.

2. 비교 대상 모델

- • UltraGCN[8]: 메시지 패싱 없이 사용자–아이템 협업 신호를 제약식 기반으로 직접 모델링하여, 고차 이웃 효과를 폐형식 근사로 흡수하는 모델.

- • LayerGCN[9]: 간결한 전파로 협업 신호를 효과적으로 집계하고 정규화 인접 행렬 전파와 레이어 가중합으로 구성된 선형형 GCN(LightGCN 계열) 모델.

- • GraphAug[10]: 엣지/노드/특징 수준의 그래프 증강을 통해 여러 뷰를 학습하고, 일관성·대조 학습으로 강건한 표현을 획득하는 모델.

- • TransGNN[11]: GNN 전파로 지역 구조를 수집하고, Transformer 자기-어텐션으로 장거리 의존성을 정교화하는 하이브리드 구조의 모델.

3. 평가지표

추천 결과의 정확도는 다음 두 가지 랭킹 기반 지표를 기준으로 평가하였다.

- • Recall@20: 추천 목록 내에 실제 테스트 아이템이 존재할 확률

- • NDCG@20: 정확도뿐 아니라 순위 정보도 측정한 정규화된 값

4. 전체 결과

하이브리드 구조가 전역(Transformer) + 지역(message passing) 신호를 함께 활용하고, 스펙트럴 위치 인코딩으로 토폴로지 인식을 부여해 희소·롱테일 상호작용(Tmall)과 다양한 커뮤니티 구조(Yelp) 모두에서 상위 랭킹 품질을 끌어올린다. R@20뿐 아니라 NDCG@20도 동반 상승해 상위권 정렬 품질이 실제로 개선되었다.

5. 제거 실험

종합하면, message passing(지역)과 Transformer(전역)가 서로 보완되고, SPE가 두 모듈을 그래프 위상에 정렬시키며 멀티스케일 정보 보존을 돕는다. 이 상호작용으로 기존 GNN이 깊어지며 겪는 oversmoothing을 완화하고, 다양한 데이터 조건에서 안정적 성능 우위를 확보하였다.

Ⅳ. 결 론

본 연구에서는 그래프 신경망(GNN)과 Transformer의 장점을 결합한 하이브리드 추천 모델을 제안하였다. GNN은 그래프의 구조적 정보를 효과적으로 학습할 수 있는 반면, 전역 관계를 포착하는 데 한계를 가지며, Transformer는 전역적인 표현 학습에는 강점을 가지지만 그래프의 위상 정보를 반영하는 데에 부족함이 있다. 이를 보완하기 위해, 제안 모델은 GNN 기반 메시지 전달과 Transformer 기반 인코더를 통합하여 지역성과 전역성을 동시에 반영하였으며, 그래프 라플라시안의 고유벡터 기반 스펙트럴 임베딩을 위치 인코딩(Positional Encoding)으로 활용하여 그래프 구조를 더욱 정밀하게 반영하였다. 제안한 모델은 기존 대표 모델 대비 Recall@20과 NDCG@20에서 각각 향상을 달성하였다. 향후 LLM 기반의 연구들과의 비교로 확장할 계획이다[12].

Acknowledgments

이 논문의 결과 중 일부는 한국방송·미디어공학회 2025년 하계학술대회에서 발표한 바 있음

This research was supported by the Basic Science Research Program of the National Research Foundation (NRF) funded by the Korean government (MSIT) (No. IITP-2025-RS-2024-00346737); and by three additional grants from the Institute for Information & Communications Technology Planning & Evaluation (IITP) funded by the Ministry of Science and ICT (MSIT), Korea, through the Global Scholars Invitation Program (No. RS-2024-00459638), the Graduate School of Metaverse Convergence at Sungkyunkwan University (No. RS-2023-00254129), and the ICT Challenge and Advanced Network of HRD (ICAN) support program (No. RS-2023-00259497)

References

-

Q. Li, Z. Han, X.-M. Wu, “Deeper insights into graph convolutional networks for semi-supervised learning,” Proceedings of the Thirty-Second AAAI Conference on Artificial Intelligence, No. 433, pp. 3538–3545, 2018.

[https://doi.org/10.1609/aaai.v32i1.11604]

-

U. Alon, E. Yahav, “On the bottleneck of graph neural networks and its practical implications,” arXiv preprint arXiv:2006.05205, , 2020.

[https://doi.org/10.48550/arXiv.2006.05205]

-

A. Vaswani, N. Shazeer, N. Parmar, J. Uszkoreit, L. Jones, A. N. Gomez, Ł. Kaiser, I. Polosukhin, “Attention is all you need,” Advances in Neural Information Processing Systems, vol. 30, 2017.

[https://doi.org/10.5555/3295222.3295349]

-

E. Min, J. Guo, X. Liu, L. Wang, J. Zhang, G. Zhang, “Transformer for graphs: An Overview from architecture perspective,” arXiv preprint arXiv:2202.08455, , 2022.

[https://doi.org/10.48550/arXiv.2202.08455]

-

Y. Shin, J. Choi, H. Wi, and N. Park, “An attentive inductive bias for sequential recommendation beyond the self-attention,” Proceedings of the AAAI Conference on Artificial Intelligence, vol. 38, no. 8, pp. 8984–8992, 2024.

[https://doi.org/10.1609/aaai.v38i8.28747]

-

X. He, K. Deng, X. Wang, Y. Li, Y. Zhang, M. Wang, “LightGCN: Simplifying and powering graph convolution network for recommendation,” Proceedings of the 43rd International ACM SIGIR Conference on Research and Development in Information Retrieval, 2020.

[https://doi.org/10.1145/3397271.3401063]

-

F. R. K. Chung, “Spectral Graph Theory,” vol. 92, American Mathematical Society, 1997.

[https://doi.org/10.1090/cbms/092]

-

K. Mao, J. Zhu, X. Xiao, B. Lu, Z. Wang, and X. He, “UltraGCN: Ultra simplification of graph convolutional networks for recommendation,” Proceedings of the 30th ACM International Conference on Information and Knowledge Management (CIKM), pp. 1253–1262, 2021.

[https://doi.org/10.1145/3459637.3482291]

-

X. Zhou, D. Lin, Y. Liu, and C. Miao, “Layer-refined graph convolutional networks for recommendation,” 2023 IEEE 39th International Conference on Data Engineering (ICDE), pp. 1247–1259, 2023. IEEE. 2023.

[https://doi.org/10.1109/ICDE55515.2023.00100]

-

Q. Zhang, L. Xia, X. Cai, S. M. Yiu, C. Huang, and C. S. Jensen, “Graph augmentation for recommendation,” 2024 IEEE 40th International Conference on Data Engineering (ICDE), pp. 557–569, 2024.

[https://doi.org/10.1109/ICDE60146.2024.00049]

-

P. Zhang, Y. Yan, X. Zhang, C. Li, S. Wang, F. Huang, and S. Kim, “TransGNN: Harnessing the collaborative power of Transformers and graph neural networks for recommender systems,” Proceedings of the 47th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR ’24), pp. 1285–1295, 2024.

[https://doi.org/10.1145/3626772.3657721]

-

N. Lee, and J Kim, “SEALR: Sequential Emotion-Aware LLM-Based Personalized Recommendation System,” Proceedings of the 48th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR ’25), pp. 2906-2910, 2025.

[https://doi.org/10.1145/3726302.3730249]

- 현재 : 성균관대학교 전자전기컴퓨터공학과

- ORCID : https://orcid.org/0009-0005-5232-3586

- 주관심분야 : Recommender System, Graph Theory

- 현재 : 성균관대학교 인공지능융합학과

- ORCID : https://orcid.org/0009-0009-9453-1841

- 주관심분야 : Recommender System, Information Retrieval

- 현재 : 성균관대학교 인공지능융합학과/소셜이노베이션융합전공 석사과정

- ORCID : https://orcid.org/0009-0006-6545-6422

- 주관심분야 : Recommender System, Natural Language Processing

- 현재 : 성균관대학교 소프트웨어학과 석사과정

- 한국방송‧미디어공학회 학생회원

- ORCID : https://orcid.org/0009-0005-6171-9099

- 주관심분야 : Natural Language Processing, Generation, Recommender System,

- 현재 : 성균관대학교 글로벌융합학부 인공지능융합전공/소프트웨어학과/데이터사이언스융합학과/소셜이노베이선융합전공/실감미디어공학과/소비자학과 부교수

- 한국지능시스템학회, 한국방송‧미디어공학회 종신회원

- ACM / IEEE 정회원

- ORCID : https://orcid.org/0000-0001-5174-0074

- 주관심분야 : Recommender System, Genetic Algorithm, Pattern Analysis