이산 데이터에서의 관계 추출을 위한 물리 프록시 기반 학습 프레임워크

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

우리는 물리 정보 기반 신경망 (PINN)을 자연어 처리와 같은 이산 데이터 영역에 적용하기 위한 새로운 프레임워크를 제안한다. 미분 가능한 방정식이 없는 이산 데이터의 한계를 극복하기 위해 데이터 내의 결정론적 관계를 근사하는 물리 프록시 개념을 도입했다. 스탠포드 관계 추출 데이터셋(TACRED)를 대상으로 결정 트리를 물리 프록시로 정의하고 여기서 계산된 보조 손실함수를 기본 딥러닝 모델의 손실함수와 통합했다. 실험 결과 BERT 기반의 딥러닝 모델에 물리 프록시를 적용했을 때 F1 점수가 2.14% 향상되었으며 더 빠르고 안정적인 학습 수렴을 보였다. 제안된 방법은 미분 가능한 방정식이 없는 이산 데이터에 폭넓게 적용할 수 있을 것으로 기대된다.

Abstract

We propose a novel framework for applying physics-informed neural networks (PINNs) to discrete data domains such as natural language processing. To overcome the limitation of discrete data lacking differentiable equations, we introduce the concept of a physics proxy that approximates deterministic relationships within the data. Using the TACRED relation extraction dataset, we define a decision tree as the physics proxy and integrate the auxiliary loss computed from it with the loss function of the base deep learning model. Experimental results show that applying the physics proxy to a BERT-based deep learning model improves the F1 score by 2.14% and achieves faster and more stable convergence. The proposed method is expected to be broadly applicable to discrete data domains without differentiable equations.

Keywords:

Physics-Informed Neural Networks, Relation Extraction, Discrete Data, Auxiliary Loss, Physics ProxyⅠ. 서 론

최근 인공지능 분야는 매개변수의 수를 폭발적으로 증가시킨 거대 언어 모델(Large Language Models)의 등장으로 전례 없는 발전을 이루었다[1]. LLM 모델들은 방대한 양의 데이터를 학습하여 다양한 자연어 처리 과제에서 인간의 능력을 넘어서는 성능을 보이고 있다[2]. 하지만 모델의 규모가 커짐에 따라 막대한 양의 학습 데이터와 컴퓨팅 자원에 대한 의존도가 심화되었으며, 모델의 예측 과정을 해석하기 어려운 블랙박스 문제 또한 중요한 과제로 남아있다. 이러한 배경 속에서, 데이터 기반의 학습 패러다임을 보완하고 도메인 지식을 효과적으로 통합하려는 새로운 연구 방향에 대한 필요성이 대두되고 있다[3]. 대안 중 하나로 물리 정보 기반 신경망(Physics-Informed Neural Networks, PINN)이 주목받고 있다[4]. PINN은 미분 방정식으로 표현되는 물리 법칙을 신경망의 손실함수에 직접 통합하는 프레임워크이다. 이를 통해 물리 법칙을 만족하는 해를 탐색하도록 모델을 규제함으로써, 적은 양의 데이터만으로도 높은 정확도를 달성하고 물리적으로 타당한 결과를 도출할 수 있다. 유체 역학, 재료 과학 등 명확한 물리 법칙이 존재하는 연속적인 데이터 영역에서 PINN은 그 유효성을 성공적으로 입증해 왔다. 하지만 자연어와 같이 이산적 데이터를 다루는 영역에서는 직접 적용하기 어렵다는 근본적인 한계가 존재한다. 텍스트 데이터에는 미분 방정식과 같은 명시적인 지배 방정식이 존재하지 않으며, 단어와 문장은 연속적인 변수가 아닌 불연속적인 기호의 나열이기 때문이다. 이로 인해 도메인 지식을 활용하여 모델의 학습 효율과 강건함을 높이려는 PINN의 잠재력은 자연어 처리 분야에서 충분히 탐색되지 못했다. 본 논문은 이러한 한계를 극복하기 위해 이산 데이터 영역에 PINN의 핵심 철학을 적용할 수 있는 새로운 학습 프레임워크를 제안한다. 우리는 물리 법칙이 없는 이산 데이터 환경에서 그 역할을 대리하는 ‘물리 프록시(Physics Proxy)’라는 개념을 도입한다. 물리 프록시는 실제 물리 법칙처럼 전체 데이터 분포를 지배하는 보편적인 규칙은 아니지만, 데이터 내에 존재하는 결정론적이고 일반화 가능한 패턴을 근사하여 모델 학습을 위한 보조적인 가이드 역할을 수행한다. 즉, 복잡한 주 과제를 학습하는 신경망이 간단하고 명확한 보조 과제를 동시에 고려하도록 유도하여 전체 학습 과정을 안정화하고 일반화 성능을 향상시키는 것을 목표로 한다.

본 연구에서는 관계 추출을 대상으로 제안하는 프레임워크의 효용성을 검증한다. 관계 추출은 문장에서 개체(entity) 쌍 사이의 의미적 관계를 분류하는 과제로, 미묘한 문맥적 단서에 의존하기 때문에 높은 수준의 추론 능력을 요구한다. 우리는 표준 벤치마크 데이터셋인 스탠포드 관계 추출 데이터셋(TACRED[18])에서 입력과 출력이 명확하게 1:1로 대응되는 데이터 부분집합을 추출하고, 이를 학습한 결정 트리를 물리 프록시로 정의하였다. 이 프록시로부터 계산된 보조 손실함수를 BERT[11] 기반의 주 모델에 통합하여 학습을 진행했다. 실험 결과, 제안하는 프레임워크는 기존 모델 대비 높은 성능 향상을 보였을 뿐만 아니라, 더 빠르고 안정적인 학습 수렴 과정을 나타냈다.

본 논문의 주요 기여는 다음과 같다.

- · PINN을 이산 데이터 영역으로 확장하기 위하여 ‘물리 프록시’ 개념을 제안한다.

- · 물리 프록시를 보조 손실함수 형태로 기존 딥러닝 모델에 통합하는 유연하고 일반적인 학습 프레임워크를 제시한다.

- · 관계 추출 과제에 대한 실험을 통해 제안하는 프레임워크가 모델의 성능과 학습 안정성을 실질적으로 향상시킬 수 있음을 입증한다.

Ⅱ. 관련 연구

본 연구는 물리 정보 기반 신경망(PINN), 관계 추출, 그리고 자연어 처리 모델에 도메인 지식을 통합하려는 연구 흐름과 밀접하게 연관되어 있다.

1. 물리 정보 기반 신경망(PINN)

물리 정보 기반 신경망은 데이터 기반의 딥러닝 모델에 미분 방정식으로 표현되는 물리 법칙을 통합하는 연구 패러다임이다[4]. 신경망이 데이터의 패턴을 학습하는 동시에 물리 법칙을 만족하도록 손실함수를 설계함으로써, 두 가지 주요 이점을 가진다. 첫째, 물리적 제약 조건은 해의 탐색 공간을 줄여주는 강력한 정규화 역할을 수행하여, 적은 데이터만으로도 모델이 빠르고 정확하게 수렴하도록 돕는다. 둘째, 학습된 모델은 데이터에만 의존하지 않고 물리 법칙을 따르므로, 물리적으로 타당하고 높은 일반화 성능을 보이는 결과를 도출한다.

PINN의 성공에 힘입어, 도메인 지식을 신경망에 통합하려는 다양한 접근법이 제안되었다.

[5]는 이러한 연구들을 지식 통합 방식에 따라 분류하였다. 대표적으로, 물리 법칙을 손실함수에 추가하여 학습을 보조하는 방식[4], 물리 모델의 결과로 신경망의 초기 가중치를 설정하는 방식[6], 지식을 기반으로 신경망의 구조 자체를 설계하는 방식[7], 그리고 물리 모델과 신경망을 결합하는 하이브리드 방식[8] 등이 있다. 통합 방식에 대한 연구 외에도 유체 역학 분야 및 생물 의학 분야 등 다양한 도메인에서 성공적으로 확장되고 있다[9,10].

이러한 연구들은 명확한 수학적 모델이 존재하는 공학 및 환경 시스템 분야에서 딥러닝 모델의 신뢰성과 효율성을 크게 향상시켰다. 하지만 이 모든 접근법은 지식이 미분 방정식과 같은 연속적인 형태로 표현될 수 있다는 것을 전제로 하므로, 텍스트와 같은 이산 데이터 영역에는 직접 적용하기 어렵다는 한계를 공유한다.

2. 관계 추출(Relation Extraction)

관계 추출은 주어진 텍스트에서 두 개체 사이의 의미적 관계를 식별하고 분류하는 자연어 처리의 핵심 과제 중 하나이다. 초기 연구들은 어휘 자질이나 구문 분석 트리에 기반한 전통적인 기계 학습 방법을 사용했지만, 딥러닝의 발전과 함께 순환 신경망이나 컨볼루션 신경망을 활용하는 방식으로 전환되었다. 최근에는 BERT[11]와 같은 사전 학습된 거대 언어 모델을 기반으로 한 방법론이 관계 추출 연구를 지배하고 있다. 이러한 모델들은 대규모 텍스트 코퍼스로부터 풍부한 언어적 지식을 사전 학습한 후, 관계 추출 데이터셋에 미세 조정하는 과정을 거친다. 이를 통해 문맥을 깊이 있게 이해하고 개체 간의 복잡한 의미 관계를 효과적으로 포착하여 높은 성능을 달성했다. 해당 연구로 개체 경계 정보를 명시적으로 학습한 SpanBERT[12]나 개체의 유형 정보를 활용하여 성능을 끌어올린 LUKE[13]와 같은 연구들이 제안되며 관계 추출 기술은 지속적으로 발전해 왔다. 하지만 이러한 모델들은 여전히 방대한 양의 레이블링된 데이터에 의존하며, 데이터에 나타나지 않는 논리적 관계나 상식적 제약을 학습하는 데에는 어려움을 겪는다.

3. 자연어 처리를 위한 지식 통합

데이터 기반 모델의 한계를 보완하기 위해, 자연어 처리 분야에서도 외부 지식을 통합하려는 연구가 활발히 진행되어 왔다. 대표적인 예로, 지식 그래프에 포함된 사실 정보를 모델의 임베딩 공간에 주입하거나, 논리 규칙을 소프트 제약의 형태로 손실함수에 추가하여 모델의 추론 과정을 규제하려는 시도들이 있었다[14,15]. 또한, 보조 과제를 활용하여 모델의 일반화 성능을 높이려는 연구도 다수 존재한다. 예를 들어, 문장의 구문 구조를 예측하거나 개체의 유형을 맞추는 등의 추가적인 과제를 함께 학습시켜 모델이 더 풍부한 언어적 특징을 학습하도록 유도하는 방식이다[16]. 이러한 접근법들은 모델의 성능 향상에 기여했지만, PINN처럼 명확한 프레임워크 하에서 도메인 지식을 체계적으로 활용하기보다는, 특정 과제에 특화된 휴리스틱한 방법을 사용하는 경우가 많았다.

본 연구는 이러한 연구 흐름 속에서 PINN의 체계적인 지식 통합 철학을 이산 데이터에 적용한다는 점에서 차별점을 가진다. 우리는 명시적인 물리 법칙 대신 데이터 자체로부터 추출한 일반화된 규칙인 물리 프록시를 통해 보조 손실을 구성함으로써, 기존 딥러닝 모델의 학습 안정성과 성능을 향상시키는 새로운 학습 프레임워크를 제안한다.

Ⅲ. 제안 방법

본 연구는 이산 데이터 환경에서 물리 정보 기반 신경망의 아이디어를 적용하기 위한 물리 프록시 기반 학습 프레임워크를 제안한다. 제안하는 프레임워크는 복잡한 주 과제를 해결하는 주 신경망과, 데이터 내의 일반화된 규칙을 근사하는 물리 프록시라는 두 가지 핵심 요소로 구성된다.

1. 제안 구조

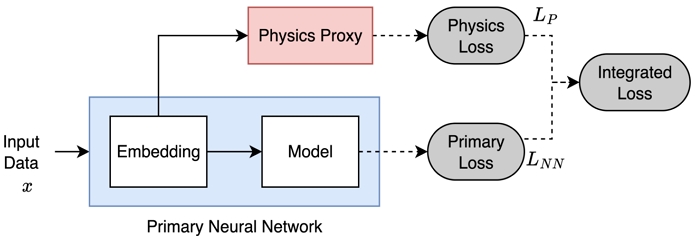

제안하는 프레임워크의 전체 구조는 그림 1과 같다.

- · 주 신경망(Primary Neural Network): 입력 문장 x가 주어지면, 주 신경망은 관계 추출 과제를 수행하여 예측값 를 출력한다. 이 예측값은 실제 정답 y와 비교되어 주 손실(LNN)을 계산하는 데 사용된다. 이는 일반적인 지도 학습 과정과 동일하다.

- · 물리 프록시(Physics Proxy): 주 신경망의 중간 출력 또는 최종 예측값은 물리 프록시 모듈로 전달된다. 물리 프록시는 입력이 데이터 내에 사전 정의된 단순한 규칙이나 제약을 만족하는지를 평가한다. 이 평가 결과는 물리 프록시의 예측값과 비교되어 물리 손실(LP)을 계산한다.

- · 통합 손실함수(Integrated Loss): 최종적으로 모델의 가중치를 업데이트하는데 사용되는 전체 손실(L)은 주 손실(LNN)과 물리 손실(LP)의 가중합으로 구성된다. 이를 통해 주 신경망은 주 과제를 해결하는 동시에, 물리 프록시가 제시하는 제약 조건을 만족하는 방향으로 학습이 유도된다.

2. 물리 프록시의 정의 및 학습

물리 프록시는 명시적인 물리 법칙이 없는 이산 데이터 환경에서 그 역할을 대리하는 모듈이다. 본 연구에서는 물리 프록시를 정의하기 위해 다음과 같은 가정을 기반으로 접근한다.

가정 1: 현재 사용 가능한 대규모 학습 데이터의 분포는 해당 도메인의 보편적이고 일반적인 패턴을 충분히 반영하고 있다고 가정한다.

가정 2: 데이터 전체에는 확률적이고 모호한 관계가 다수 존재하지만, 그중에는 입력과 출력이 명확하게 1:1로 대응되는 결정론적인 관계도 존재한다. 이러한 부분집합은 데이터의 근본적인 규칙을 대표할 수 있다.

이러한 가정을 바탕으로, 전체 학습 데이터에서 부분집합을 추출하여 패턴을 학습하는 간단한 모델을 물리 프록시로 정의한다. 또한 본 연구의 관계 추출 과제에서는 다음과 같은 절차를 따른다.

- · 데이터 선정

Data 1: TACRED 학습 데이터셋 전체에서 하나의 입력 개체 쌍([esbj, eobj])이 단 하나의 관계 유형으로만 레이블링된 샘플들을 추출한다. 이는 ‘가정 2’에 따라 데이터의 모호성을 제거하고 명확한 규칙을 학습하기 위함이다. 이 과정을 통해 전체 학습 데이터의 약 80.4%에 해당하는 54,790 문장이 선정되었다.

Data 2: 데이터 1에서 추출된 샘플에서 관계를 기준으로 언더 샘플링(Under Sampling)을 수행한 샘플로 구성한다. 전체 학습 데이터의 22.8%, 15,151 문장이 해당한다. - · 문제 단순화: 물리 프록시는 주 과제(42개 관계 분류)보다 훨씬 간단하고 일반적인 과제를 수행하도록 설계한다. 본 연구에서는 관계의 유무, 즉 ‘관계 있음(R)’과 ‘관계 없음(~ R)’을 예측하는 이진 분류 과제로 단순화하였다.

- · 자질 추출 및 모델 학습: 물리 프록시 학습을 위해 다음과 같은 자질을 사용한다. 각 자질은 주 신경망인 BERT 모델을 통과하여 얻은 임베딩 벡터를 활용한다.

✔ 문장(Sentence): 문장 전체의 의미 정보를 담고 있는 [CLS] 토큰의 임베딩

✔ 개체(Entity): 주어 개체(esbj)와 목적어 개체(eobj)에 해당하는 토큰들의 평균 임베딩

✔ 문맥(Context): 두 개체 사이에 위치한 문맥 단어들의 평균 임베딩

추출된 자질을 입력으로 하여, ‘관계 있음(R)/없음(~ R)’을 예측하도록 결정 트리[17] 모델을 학습시킨다. 결정 트리는 학습이 빠르고, 데이터의 불균형 문제에 강건하며, 학습된 규칙을 해석하기 용이하다는 장점이 있어 물리 프록시 모델로 선정하였다.

3. 통합 학습

학습된 물리 프록시는 주 신경망의 학습을 유도하는 보조 모듈로 작동한다. 그림 1과 같이, 주 신경망의 학습 과정에서 계산된 주 손실(LNN)과 물리 프록시를 통해 계산된 물리 손실(LP)은 하이퍼파라미터 λ에 의해 가중치가 조절되어 하나의 통합 손실함수로 합쳐진다. 이 통합 손실 L로부터 계산된 그래디언트(gradient)는 역전파를 통해 물리 프록시의 입력 자질을 생성한 주 신경망의 임베딩 레이어를 포함한 모든 파라미터를 업데이트하는 데 사용된다. 그림 1의 물리 프록시로 향하는 실선은 손실 계산에 필요한 정보(자질)의 흐름을 나타내며, 최종적으로 계산된 손실은 주 신경망 전체의 학습에 영향을 미친다.

| (1) |

여기서 LNN은 주 신경망의 42개 관계 분류에 대한 크로스-엔트로피 손실이며, LP는 물리 프록시의 이진 분류에 대한 크로스-엔트로피 손실이다. λ값은 물리 프록시의 제약 조건을 얼마나 강하게 적용할지를 결정하는 역할을 하며, 0과 1 사이의 값을 가진다. λ=0이면 물리 프록시를 사용하지 않는 순수한 딥러닝 모델과 동일하며, λ값이 커질수록 물리 프록시가 제시하는 일반적인 규칙을 더 강하게 따르도록 학습이 진행된다.

Ⅳ. 실 험

제안하는 물리 프록시 기반 학습 프레임워크의 효용성을 검증하기 위한 실험 설계와 그 결과에 대해 상세히 기술한다. 실험은 다음 두 가지 질문에 답하는 것을 목표로 한다: 1) 데이터로부터 추출된 물리 프록시는 유의미한 보조 신호를 생성할 수 있는가? 2) 물리 프록시를 통합한 모델은 기존 딥러닝 모델과 비교하여 성능 및 학습 안정성 측면에서 이점을 가지는가?

1. 실험 환경

실험에는 관계 추출을 위한 대규모 벤치마크 데이터셋인 TACRED를 사용하였다(표 1).

TACRED는 TAC KBP(Text Analysis Conference Knowledge Base Population) 챌린지의 데이터를 기반으로 구축되었으며, 총 106,264개의 문장으로 구성되어 있다. 각 문장에는 주어, 목적어 개체 쌍이 태깅되어 있으며, 이들의 관계는 관계 없음(no_relation) 1개를 포함하여 총 42개의 유형으로 분류된다. 데이터셋의 특징은 관계 없음 클래스가 전체의 약 80%를 차지하는 심각한 데이터 불균형 문제를 포함하고 있다는 점이다. 통합 손실 가중치 λ와 같은 주요 하이퍼파라미터는 검증 데이터(Validation Data)의 성능을 기준으로 결정하였으며, 평가 결과는 테스트 데이터(Test Data)를 사용하였다. 평가는 관계 추출 태스크에서 표준적으로 사용되는 Micro F1 점수를 주요 지표로 사용하며, 정밀도와 재현율을 함께 표기하여 결과를 다각적으로 분석한다. 주 신경망 모델로는 BERT(large) 모델을 사용했으며, 복잡한 추가 구조 없이 간단한 분류 헤드를 추가함으로서 다른 복합적인 구조의 영향을 배제하고 제안하는 프레임워크 자체 효과를 검증하고자 하였다. 주 신경망 모델의 미세 조정에는 AdamW 옵티마이저를 사용하였으며, 학습율은 3e-5, 배치 크기는 64로 설정하였다. 모든 실험은 최대 100 세대(epoch)까지 진행할 수 있으며, 검증 데이터셋 성능에 기반하여 성능 개선이 3세대 동안 이루어지지 않을 경우 조기 종료(early stopping)를 적용하였다.

2. 물리 프록시 성능 평가

본 실험은 물리 프록시가 주 모델의 학습을 유도할 만큼 의미 있는 보조 신호를 생성할 수 있는지 확인하는 것을 목표로 한다. 제안 방법에서 정의한 방식에 따라, ‘관계 있음/없음’을 예측하는 이진 분류기로서 물리 프록시의 성능을 측정했으며, 그 결과는 표 2와 같다. ‘관계 있음/없음’의 비율(R/~ R ratio)은 물리 프록시인 결정나무에서 자식 노드를 생성할 때 관계 있음/없음을 나눈 비율을 의미한다. 이는 데이터의 불균형을 보완하기 위한 방법으로 사용한다. 가장 높은 성능을 보인 것은 Data 2에서 문장과 개체 문맥 자질을 함께 사용한 경우로, F1 점수 57.07을 기록했다. 이 수치는 물리 프록시의 역할이 완벽한 분류기가 아닌 ‘학습의 방향을 제시하는 가이드’라는 점을 고려할 때 주목할 만하다. 이는 전체 학습 데이터의 약 22.8%라는 일부 데이터만으로도 데이터 내에 존재하는 일반적인 패턴을 성공적으로 학습하고 구별해낼 수 있음을 시사한다. 따라서 주 모델에 유용한 보조 손실 신호를 제공할 수 있는 충분한 잠재력을 갖춘 것으로 판단할 수 있다.

3. 프레임워크 통합 성능 평가

물리 프록시를 주 신경망에 통합했을 때의 최종 성능을 평가하기 위해, 통합 손실 가중치 λ값을 조정하며 실험을 진행했다. 기준(Base)은 물리 프록시를 사용하지 않은 BERT(large) 모델을 의미한다. 실험 결과는 표 3과 같다. Data는 학습 데이터 전체를 의미하는 것이고, 결과(Precision, Recall, F1 score)는 테스트 데이터에 대한 결과를 보여준다. 제안하는 프레임워크를 적용했을 때, ‘NN/Physics 비율 0.8/0.2’에서 F1 점수 69.64를 기록하며 가장 높은 성능을 보였다. 이는 기준 모델의 67.5 대비 약 2.14%p 향상된 수치로, 물리 프록시가 모델의 최종 성능 개선에 실질적으로 기여했음을 명확히 보여준다. 특히, 정밀도가 63.42에서 70.38로 크게 향상된 점이 두드러지는데, 이는 물리 프록시가 제시하는 일반적인 규칙이 모델이 더 확실한 근거를 바탕으로 예측하도록 규제하는 역할을 했음을 시사한다. 반면, λ값을 0.7까지 높였을 때는 오히려 성능이 감소했는데, 이는 주 과제의 복잡성에 비해 물리 프록시의 단순한 신호가 과도하게 반영되어 학습을 방해했기 때문으로 분석된다. Data 1, 2는 재현율이 높아지는데 비해 정밀도가 낮은 것은, 주 신경망에서 전체 샘플을 학습하지 않아 학습되지 않은 샘플의 예측 오류로 전체 성능이 떨어졌다.

4. 학습 안정성 분석

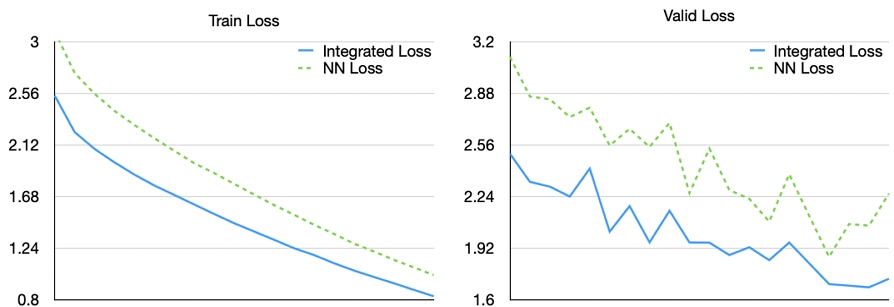

물리 프록시가 모델의 학습 과정 자체에 미치는 영향을 분석하기 위해 훈련 및 검증 손실의 변화 추세를 관찰했다(그림 2). 통합 모델의 손실과 기준(Base) 모델은 서로 다른 과제로부터 계산되어 절대적인 값을 직접 비교하는 것은 적절하지 않을 수 있다. 따라서 본 분석에서는 손실 곡선의 정성적인 형태에 초점을 맞추어 학습의 효율성과 안정성을 평가하고자 한다.

분석 결과, 제안하는 통합 모델은 두 가지 측면에서 뚜렷한 이점을 보였다. 첫째, 훈련 손실 곡선이 기준 모델보다 더 가파르게 감소하여 빠르게 수렴하는 경향을 보였다. 이는 물리 프록시가 제공하는 추가적인 가이드가 모델이 최적의 해를 더 효율적으로 탐색하도록 돕는다는 것을 의미한다. 둘째, 검증 손실의 변동 폭이 기준 모델에 비해 현저히 작고 안정적이었다. 기준 모델의 검증 손실이 큰 폭으로 진동하는 것은 과적합의 가능성을 내포하는 반면, 통합 모델은 학습 후반까지 안정적으로 손실이 감소하는 모습을 보여 더 나은 일반화 성능을 가질 잠재력을 시사한다. 이러한 안정성은 최적 학습 종료 시점을 특정하기 용이하게 만들어 실용적인 관점에서도 이점을 가진다.

Ⅴ. 결 론

본 논문은 물리 정보 기반 신경망(PINN)을 자연어 처리와 같은 이산 데이터 영역으로 확장하기 위한 새로운 접근법으로 ‘물리 프록시 기반 학습 프레임워크’를 제안했다. 미분 가능한 지배 방정식이 없는 이산 데이터의 본질적인 한계를 극복하고자, 데이터 내에 존재하는 결정론적이고 일반화 가능한 패턴을 근사하는 ‘물리 프록시’ 개념을 도입했다. 관계 추출 벤치마크 데이터셋인 TACRED를 대상으로 제안하는 프레임워크의 효용성을 검증한 결과, 물리 프록시를 통합한 모델은 기존 BERT 기반 모델에 비해 F1 점수가 2.14% 향상되었을 뿐만 아니라, 훈련 및 검증 손실 곡선에서 더 빠르고 안정적인 수렴 경향을 보였다. 이는 물리 프록시가 제시하는 단순하고 일반적인 제약 조건이, 주 신경망이 더 강건하고 일반화 성능이 높은 특징을 학습하도록 성공적으로 유도했음을 시사한다. 마지막으로 본 연구는 기초적인 유효성을 검증하는데 초점을 맞추었다는 점에서 한계를 가진다. 향후 연구로 발전된 구조의 최신 모델들을 적용하여 확장성과 성능을 검증하는 것뿐만 아니라 물리 프록시에 보다 정교하고 의미적인 규칙을 적용할 수 있는 구조로 보완하여 프레임워크로 더욱 발전시키고자 한다.

Acknowledgments

이 논문의 결과 중 일부는 한국방송·미디어공학회 2025년 하계학술대회에서 발표한 바 있음

This work was supported by the Institute of Information and Communications Technology Planning and Evaluation(IITP) grant funded by the Korean government(MSIT) (No. 2022-0-00320, RS-2022-II220320, Artificial Intelligence Research about Cross-Modal Dialogue Modeling for One-on-One Multi-Modal Interactions)

References

- Brown Tom, enjamin Mann, Nick Ryder and Melaanie Subbiah et al., “Language Models are Few-Shot Learners,” Proceedings of the 2020 Conference of the NeuralPS, Vol.33, pp.1877-1901, 2020.

- Aakanksha Chowdhery, Sharan Narang and Jacob Devlin et al., “PaLM: scaling language modeling with pathways,” Journal of Machine Learning Research, Vol.24, No.1, January 2023.

-

Von Rueden et al., “Informed Machine Learning – A Taxonomy and Survey of Integrating Prior Knowledge into Learning Systems,” IEEE Transactions on Knowledge and Data Engineering, Vol.35, No.1, pp.614-633, January 2023.

[https://doi.org/10.1109/TKDE.2021.3079836]

-

M. Raissi, P. Perdikaris, and G.E. Karniadakis, “Physics-informed neural networks: A deep learning framework for solving forward and inverse problems involving nonlinear partial differential equations,” Journal of Computational Physics, Vol.378, pp.686-707, 2019.

[https://doi.org/10.1016/j.jcp.2018.10.045]

-

Jared Willard, Xiaowei Jia, Shaoming Xu, Michael Steinbach, and Vipin Kumar, “Integrating Scientific Knowledge with Machine Learning for Engineering and Environmental Systems,” ACM Computing Surveys, Vol.55, No.4, November 2022.

[https://doi.org/10.1145/3514228]

-

Xiaowei Jia, Jared Willard, Anuj Karpatne, Jordan S. Read, Jacob A. Zwart, Michael Steinbach, and Vipin Kumar, “Physics-Guided Machine Learning for Scientific Discovery: An Application in Simulating Lake Temperature Profiles,” ACM/IMS Transactions on Data Science, Vol.2, No.3, August 2021.

[https://doi.org/10.1145/3447814]

-

Arka Daw and R. Quinn Thomas and Cayelan C. Carey and Jordan S. Read and Alison P. Appling and Anuj Karpatne, “Physics-Guided Architecture(PGA) of Neural Networks for Quantifying Uncertainty in Lake Temperature Modeling,” Proceedings of the 2020 SIAM International Conference on Data Mining, pp.532-540, 2020.

[https://doi.org/10.1137/1.9781611976236.60]

-

Y. Chen, S. M. Mazhari, C. Y. Chung, S. O. Faried and B. C. Pal, “Rotor Angle Stability Prediction of Power Systems With High Wind Power Penetration Using a Stability Index Vector,” IEEE Transactions on Power Systems, Vol.35, No.6, pp.4632-4643, November 2020.

[https://doi.org/10.1109/TPWRS.2020.2989725]

-

Salvatore Cuomo and Vincenzo Schiano Di Cola et al., “Scientific Machine Learning Through Physics–Informed Neural Networks: Where we are and What’s Next,” Journal of Scientific Computing, Vol.92, No.62, September 2022.

[https://doi.org/10.1007/s10915-022-01939-z]

-

Chayan Banerjee, Kien Nguyen, Olivier Salvado, Truyen Tran, and Clinton Fookes, “Physics-informed Machine Learning for Medical Image Analysis,” ACM Computing Surveys, Vol.58, October 2025.

[https://doi.org/10.1145/3768158]

-

Jacob Devlin, Ming-Wei Chang, Kenton Lee and Kristina Toutanova, “BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding,” Proceedings of the 2019 Conference of the NAACL, pp.4171-4186, Jun 2019.

[https://doi.org/10.18653/v1/N19-1423]

-

Mandar Joshi, Danqi Chen, Yinhan Liu, Daniel S. Weld, Luke Zettlemoyer and Omer Levy, “SpanBERT: Improving Pre-training by Representing and Predicting Spans,” Transactions of the Association for Computational Linguistics, Vol.8, pp.64-77, 2022.

[https://doi.org/10.1162/tacl_a_00300]

-

Ikuya Yamada, Akari Asai, Hiroyuki Shindo, Hideaki Takeda and Yuji Matsumoto, “LUKE: Deep Contextualized Entity Representations with Entity-aware Self-attention,” In Proceedings of the 2020 Conference on EMNLP, pp.6442–6454, 2020.

[https://doi.org/10.18653/v1/2020.emnlp-main.523]

-

Zhengyan Zhang, Xu Han, Zhiyuan Liu, Xin Jiang, Maosong Sun and Qun Liu, “ERNIE: Enhanced Language Representation with Informative Entities,” In Proceedings of the 57th ACL, pp.1441–1451, 2019.

[https://doi.org/10.18653/v1/P19-1139]

-

Matthew E. Peters, Mark Neumann, Robert Logan, Roy Schwartz, Vidur Joshi, Sameer Singh and Noah A. Smith, “Knowledge Enhanced Contextual Word Representations,” In Proceedings of the 2019 Conference on EMNLP and the 9th IJCNLP, pp.43–54, 2019.

[https://doi.org/10.18653/v1/D19-1005]

-

Shijie Chen, Yu Zhang, and Qiang Yang, “Multi-Task Learning in Natural Language Processing: An Overview,” ACM Computing Surveys, Vol.56, No.12, December 2024.

[https://doi.org/10.1145/3663363]

-

Nicholas Frosst and Geoffrey E. Hinton, “Distilling a Neural Network Into a Soft Decision Tree,” arXiv, 2017.

[https://doi.org/10.48550/arXiv.1711.09784]

-

Zhang, Yuhao and Zhong, Victor and Chen, Danqi and Angeli, Gabor and Manning and Christopher D., “Position-aware Attention and Supervised Data Improve Slot Filling,”, In Proceedings of the 2017 Conference on EMNLP, pp.35-45, 2017.

[https://doi.org/10.18653/v1/D17-1004]

- 2013년 : 창원대학교 컴퓨터공학과 박사

- 2015년 ~ 2018년 7월 : KT융합기술원 선임연구원

- 2018년 ~ 현재 : 창원대학교 연구교수

- ORCID : https://orcid.org/0009-0001-1742-9992

- 주관심분야 : 자연어처리, 기계학습

- 숭실대학교(학사)

- 포항공과대학교(석사, 박사)

- USC/ISI(박사후 연수)

- 2004년 ~ 현재 : 창원대학교 컴퓨터공학과 교수

- ORCID : https://orcid.org/0009-0006-5171-0696

- 주관심분야 : 자연어처리, 기계학습, 정보검색