그래프 트랜스포머 성능 강화를 위한 새로운 엣지 인코딩 기법

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

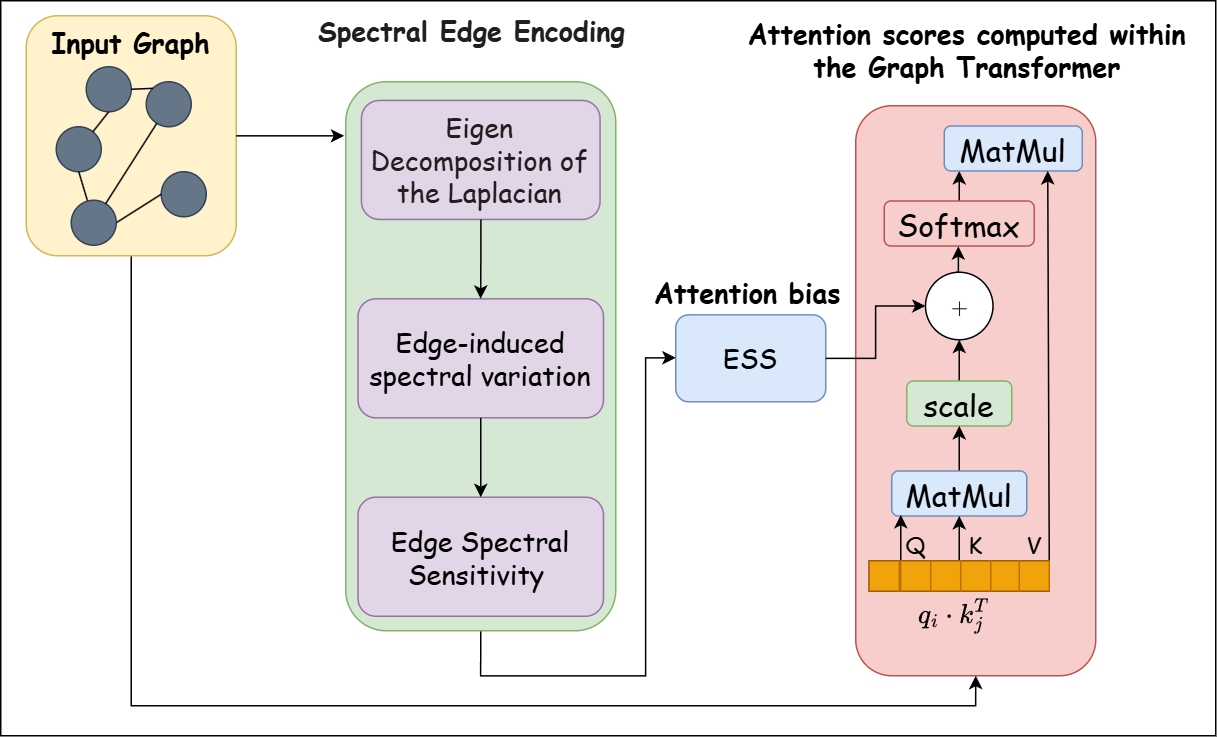

그래프 트랜스포머는 배치 순서가 없는 그래프에 어텐션을 적용하기 위해 노드 위치 인코딩(라플라시안·랜덤워크)과 엣지 바이어스 주입(거리·중심성·관계) 방식을 활용한다. 그러나 기존 모델은 노드 중심 설계로 전역 토폴로지를 충분히 반영하지 못하고, 엣지 표현도 단순 연결 여부·거리 특성에 한정된다. 이에 본 연구는 기존 노드 중심 모델이 간과해 온 전역 토폴로지 정보를 보완하기 위해 Spectral Edge Encoding(SEE)을 제안한다. SEE는 그래프 라플라시안 고유 분해와 섭동이론의 Rayleigh quotient를 결합하여 각 엣지가 저주파 고윳값에 미치는 변화를 정량화하고 이를 전역 엣지 민감도 임베딩으로 변환한다. MoleculeNet의 BBBP, ClinTox, SIDER 등 데이터셋에서 AUROC 향상을 확인하고 그래프 트랜스포머가 전역 구조 정보를 효과적으로 학습함을 보여준다.

Abstract

Graph Transformers apply attention to unordered graphs by using node positional encodings (Laplacian or random‑walk based) and injecting edge biases (distance, centrality, relational). However, existing models remain node‑centric and fail to capture global topology, while edge representations are limited to simple connectivity or distance features, making it difficult to quantify each edge’s impact on the graph’s spectral structure. To overcome these limitations, we propose Spectral Edge Encoding (SEE), which combines spectral decomposition of the graph Laplacian with the Rayleigh quotient from perturbation theory to compute how each edge perturbs low‑frequency eigenvalues and convert these changes into global edge‑sensitivity embeddings. We observe improved AUROC on MoleculeNet datasets—including BBBP, ClinTox, and SIDER—demonstrating that the graph transformer effectively learns global structural information.

Keywords:

Edge encoding, Spectral, Graph transformerⅠ. 서 론

그래프 데이터는 화학결합, 사회적 상호작용, 인프라 네트워크처럼 관계 자체가 의미를 갖는 문제를 자연스럽게 표현한다. 이러한 구조적 특성을 효과적으로 학습하기 위해 전통적으로는 메시지 패싱 기반 그래프 신경망(GNN)이 사용되어 왔다. 그러나 이웃 기반 전파에 의존해 장거리 패턴을 포착하기 어렵고, 깊이를 늘리면 과도한 스무딩, 그래디언트 소실 문제가 발생한다[1][2]. 이를 보완하기 위해 최근 그래프 트랜스포머가 활발히 연구되면서 self-attention으로 모든 노드 쌍을 직접 연결함으로써 장거리 의존성을 완화하고 있다[3].

그래프 트랜스포머가 구조 정보를 활용하려면 위치(혹은 관계) 인코딩이 필수이다. 대표적으로 다음과 같은 두 가지가 있다.

- • 노드 위치 인코딩- 라플라시안 위치 인코딩 또는 랜덤 워크 확산 좌표를 노드 특성에 더해 전역 위치를 부여하는 랜덤워크 위치 인코딩이 있음[4].

- • 엣지 바이어스- 노드 간 최단거리, 차수, 관계 유형을 어텐션 점수에 가산해 구조적 단서를 주입함[5].

이러한 방법은 성능 면에서 의미 있는 진전을 이루었으나 공통적으로 노드 중심 설계라는 한계를 가진다. 즉, 노드 간 거리가 가깝다는 사실은 알리지만 어떤 엣지가 전체 스펙트럼에 얼마나 결정적인지를 정량화하지 못한다. 그 결과 장거리 결합이 지배적인 분자 특성 예측, 네트워크 분석에서 중요한 연결을 놓쳐 정확도가 제한된다[6][7]. 또한 모델이 어떤 이유로 특정 예측을 했는지 엣지 수준에서 설명하기 어려운 문제가 있다.

이를 해결하기 위해 본 연구는 Spectral Edge Encoding(SEE)을 제안한다. 핵심 아이디어는 그래프 라플라시안의 고유벡터를 이용해 엣지가 저주파 고윳값에 유발하는 1차 섭동을 계산한 뒤 하위 K개 모드를 합산해 엣지 민감도 값을 얻는 것이다. 이 값은 어텐션 바이어스에 바로 삽입할 수 있어 간결하게 그래프 트랜스포머에 통합된다.

실험 결과, SEE를 적용한 모델은 MoleculeNet 벤치마크에서 기존 베이스 모델과 화학적 결합 정보를 활용한 모델보다 대부분 높은 정확도를 달성했다. 이는 SEE가 엣지 단위 전역 구조 신호를 효과적으로 주입해 성능과 해석력을 동시에 향상시킴을 시사한다.

Ⅱ. 관련 연구

그래프 트랜스포머의 구조적 표현 학습에 대한 연구는 최근 몇 년간 빠르게 발전해 왔다. “Do Transformers Really Perform Bad for Graph Representation?”[3]에서 그래프 트랜스포머가 기존의 그래프 합성곱 신경망(GCN)을 대체할 수 있음을 보이며, 그래프의 구조 정보를 attention bias 형태로 통합하는 Graphormer를 제안했고 노드 간 거리, 중심성 등 전역 구조 정보를 attention bias로 통합하였다.

본 연구에서 제안하는 Spectral Edge Encoding(SEE)은 이러한 바이어스 기반 구조 인코딩 방법을 라플라시안 고윳값의 스펙트럼 변동으로 확장하여, 개별 엣지가 전체 그래프의 전역적 구조에 미치는 영향을 정량적으로 반영한다는 점에서 개념적 연속성을 갖는다.

한편, “Global Self-Attention as a Replacement for Graph Convolution”[8]에서 global self-attention이 그래프 합성곱을 대체할 수 있음을 이론적으로 규명하였다. 이들은 그래프의 신호 처리를 스펙트럴 도메인에서 해석하며, 저주파 대역의 구조적 정보를 어텐션 연산으로 모델링할 수 있음을 보였다.

SEE는 이 관점을 엣지 단위로 확장하여, 저주파 고윳값(λ2, λ3 등)의 민감도 변화를 통해 각 엣지의 전역적 중요도를 평가하고, 이를 어텐션 로짓에 주입하는 스펙트럼 기반 바이어스 형태로 구현하였다. 따라서 본 연구는 기존의 전역 attention 기반 스펙트럴 모델을 엣지 중심(edge-centric) 스펙트럼 민감도 모델로 발전시킨다는 점에서 차별성을 지닌다.

Ⅲ. 제안 방법

1. Spectral Edge Encoding(SEE)

그래프에서 어떤 결합(엣지)이 전체 구조에 얼마나 중요한가를 정량화하려면 토폴로지만으로는 부족하고, 고유모드(저주파-전역/고주파-국부)의 기여를 함께 고려해야 한다. SEE는 한 엣지를 가상의 섭동으로 가정하고 그래프 라플라시안의 스펙트럼 변화를 1차 근사로 계산해 엣지 민감도를 단일 스칼라로 반환한다.

2. 라플라시안 고유 분해

그래프 G = (V,E)의 구조적 특성을 수학적으로 포착하기 위해 먼저 인접행렬 A와 차수행렬 D를 정의한 뒤, 그래프 라플라시안을 L = D - A로 도출한다. L은 대칭이고 양의 준정부호이므로 고유 분해가 가능하며, 고유 분해 L = UΛUT 통해 U = [u1,...,uV]는 서로 직교하는 고유벡터 집합으로서 그래프 푸리에 기저(각 노드 신호를 주파수 성분별로 분해-재구성할 수 있는 기반)를 형성하고 고윳값(λk)은 해당 기저 방향에서의 주파수에 대응한다[9][10]. 작은 고윳값은 그래프 상에서 변화가 완만한(저주파) 패턴 그리고 큰 고윳값은 급격한(고주파) 패턴을 나타내므로, 그래프 신호를 주파수 관점에서 분석-처리하도록 해 주는 수학적 토대를 제공한다.

3. 엣지에 의한 스펙트럼 변화량

그래프 라플라시안에서 특정 엣지가 추가·제거됨에 따른 스펙트럼 변화량을 가상의 섭동 행렬(수식 1)로 표현한다.:

| (1) |

엣지 eij를 ±1만큼 바꾸면 라플라시안의 네 칸이 변한다. 이렇게 생성된 rank-1 행렬은 결합 한 개가 주는 변화 패턴을 담고 있다[11]. 이때 섭동 크기가 충분히 작다고 가정하면, L의 k-번째 고윳값 변화는 Rayleigh quotient의 1차 근사(수식 2)로 계산된다[12].

| (2) |

즉, 고유벡터(uk) 상에서 두 노드 i,j값의 차가 클수록 해당 주파수 성분이 크게 요동하며, 이 수식으로 고윳값의 변화량을 계산한다.

4. Edge Spectral Sensitivity(ESS)

엣지 eij의 스펙트럼 민감도는 고윳값 스펙트럼 중 저주파 모드 k = 1,...,K까지만 고려해서 수식 3으로 정의된다[13].

| (3) |

본 연구의 목적인 “각 엣지가 얼마나 스펙트럼을 크게 흔드는가”를 확인하여 저주파 모드만을 강조하기 위해 을 곱해 고주파의 기여를 지수적으로 억제함으로써 저주파 모드의 변화를 더욱 두드러지게 평가하기 위한 수학적 장치이다. 즉, 엣지 섭동이 그래프 전역 구조에 미치는 영향을 부각한다. 또한 절댓값을 취해 엣지의 추가와 제거가 부호만 다를 뿐 동일한 규모의 섭동을 유발한다는 대칭성을 보존하여 민감도의 목적을 영향의 크기 하나로 일관되게 측정하도록 했다.

결과적으로 ESS는 “엣지 하나가 그래프의 저주파 스펙트럼을 얼마나 크게 섭동하는가”를 수치로 제공하여 구조적으로 핵심적인 결합을 식별하는 엣지 민감도를 계산한다. 이렇게 계산된 민감도를 attention score에 가산하는 방식으로 손쉽게 다른 모델에 적용할 수 있으며, 별도 아키텍처 변경 없이 SEE 효과를 적용할 수 있다.

Ⅳ. 실험 결과

모든 실험은 NVIDIA GH200 GPU에서 수행되었으며, MoleculeNet[14]의 BBBP, ClinTox, SIDER, MUV, Tox21 다섯 개의 데이터셋을 사용하였다. 데이터는 무작위 분할보다 일반화 평가가 더 까다로운 scaffold split[15]을 적용하여, 서로 다른 Bemis–Murcko 골격이 학습·검증·테스트 세트(8 : 1 : 1) 간에 완전히 분리되도록 구성하였다. 이를 통해 새로운 화학 골격에 대한 모델의 구조 일반화 성능을 평가하였다.

비교 모델들은 서로 다른 구조적 인코딩 전략을 기반으로 설계되었다. GEM(2022)[16]은 그래프 합성곱 네트워크(GCN)에 기하적 정보(결합 각도·거리)를 결합하여 국소 구조를 세밀하게 반영한다. Uni-Mol(2023)[17]은 대규모 분자 데이터를 이용해 3차원 좌표 예측을 사전 학습함으로써, 원자 간 공간적 상호작용을 정밀히 모델링한다. Unicorn(2024)[18]은 분자 그래프, 화학 언어, 텍스트 표현을 통합한 멀티뷰 대조 학습 프레임워크로, 구조적 신호와 화학적 의미를 동시에 학습한다. Moleco(2024)[19]는 화학 언어 모델 기반의 contrastive pretraining을 통해 문맥적·의미론적 정보를 풍부하게 학습하여, 화학적 맥락 이해에 강점을 가진다. 이에 비해 Moiré Graph Transformer(MoiréGT)[20]는 위치 인코딩을 제거하고 focused attention 구조를 채택해 전역 관계를 직접 학습하는 트랜스포머 기반 모델이다.

본 연구의 MoiréGT + SEE는 MoiréGT 위에 제안한Spectral Edge Encoding(SEE)을 결합한 구조로, 그래프 라플라시안의 저주파 고윳값 변화량을 이용해 각 엣지의 전역 스펙트럼 민감도(Edge Spectral Sensitivity, ESS)를 계산하고, 이를 어텐션 바이어스로 주입하여 전역 위상 구조의 영향도(global topological sensitivity)를 정량적으로 반영한다. 이러한 접근은 기존 노드 중심 모델이 다루지 못한 전역 구조 정보를 보강함으로써, MoiréGT 대비 예측 성능 향상뿐 아니라 엣지 수준의 해석 가능성 또한 강화한다.

표 1의 결과에서 보듯, MoiréGT + SEE는 기본 MoiréGT 및 화학 결합 특성을 주입한 MoiréGT + Bond보다 모든 데이터셋에서 높은 AUROC를 달성하였다. 다만, Moleco와 비교하면 일부 데이터셋(예: ClinTox, MUV)에서는 약간 낮은 성능을 보였으나, 이는 Moleco가 대규모 화학 언어모델 기반 사전학습을 통해 화학적 문맥 정보와 의미론적 상호작용을 직접 반영하는 데 강점을 가지기 때문이다. 또한, MUV의 경우 다중 라벨 구조와 높은 화학적 다양성을 지닌 대규모 데이터셋으로, 그래프 구조 외의 문맥적 특징이 예측에 크게 작용한다. Unicorn은 멀티뷰 대조 학습을 통해 이러한 화학적·언어적 정보를 함께 반영하므로, 해당 태스크에서 상대적으로 유리한 결과를 보인 것으로 해석된다.

MoleculeNet benchmark classification tasks (Area Under the Receiver Operating Characteristic curve, AUROC; higher values indicate better performance). The best and second-best results are highlighted in bold and underlined, respectively

반면, SEE는 그래프의 전역 스펙트럼 구조에 초점을 맞춰 구조적 상호작용을 강조하기 때문에, 화학적 의미가 주요한 태스크에서는 상대적으로 성능 차이가 발생할 수 있다. 그럼에도 불구하고 SEE는 전역 구조 중심 인코딩 기법으로서 가능성을 보이며, 그래프의 스펙트럼 관점에서 구조적 중요도를 정량화할 수 있는 새로운 방향성을 제시한다.

Ⅴ. 결론 및 향후 연구 내용

본 연구는 기존 노드 중심 모델이 간과하던 전역 토폴로지 정보를 보완하기 위해 Spectral Edge Encoding(SEE)를 도입하였다. SEE는 그래프 라플라시안 고유 분해와 Rayleigh quotient 기반 섭동이론을 결합해 엣지 민감도를 정량화하고, 이를 MoiréGT에 통합해 예측 성능을 유의미하게 향상시켰다. 한편, 라플라시안 고유 분해는 노드 수가 많은 대규모 그래프에서 연산 비용이 증가하며, 본 실험은 분자 특성 분류의 소규모 데이터셋에 국한되었다. 앞으로는 근사 스펙트럴[21] 기법을 활용해 확장성을 높이고, 다양한 그래프 태스크·대규모 데이터셋으로 범위를 넓혀 SEE의 일반성과 효용을 검증할 계획이다.

Acknowledgments

이 논문의 결과 중 일부는 한국방송·미디어공학회 2025년 하계학술대회에서 발표한 바 있음

This research was supported by the Basic Science Research Program of the National Research Foundation (NRF) funded by the Korean government (MSIT) (No. IITP-2025-RS-2024-00346737); and by three additional grants from the Institute for Information & Communications Technology Planning & Evaluation (IITP) funded by the Ministry of Science and ICT (MSIT), Korea, through the Global Scholars Invitation Program (No. RS-2024-00459638), the Graduate School of Metaverse Convergence at Sungkyunkwan University (No. RS-2023-00254129), and the ICT Challenge and Advanced Network of HRD (ICAN) support program (No. RS-2023-00259497)

References

-

T. N. Kipf and M. Welling, “Semi‑Supervised Classification with Graph Convolutional Networks,” inProceedings of the 5th International Conference on Learning Representations, Toulon, France, April 2017.

[https://doi.org/10.48550/arXiv.1609.02907]

-

G. Li, C. Xiong, A. Thabet, and B. Ghanem, “DeeperGCN: All You Need to Train Deeper GCNs,” arXiv preprint, June 2020.

[https://doi.org/10.48550/arXiv.2006.07739]

-

C. Ying, T. Cai, S. Luo, S. Zheng, G. Ke, D. He, Y. Shen, and T.-Y. Liu, “Do Transformers Really Perform Badly for Graph Representation?,” Advances in Neural Information Processing Systems, vol. 34, pp. 28877–28888, December 2021.

[https://doi.org/10.5555/3540261.3542473]

-

V. P. Dwivedi and X. Bresson, “A Generalization of Transformer Networks to Graphs,” arXiv preprint, December 2020.

[https://doi.org/10.48550/arXiv.2012.09699]

-

L. Rampášek, M. Galkin, V. P. Dwivedi, A. T. Luu, G. Wolf, and D. Beaini, “Recipe for a General, Powerful, Scalable Graph Transformer,” Advances in Neural Information Processing Systems, vol. 35, pp. 14501–14515, December 2022.

[https://doi.org/10.48550/arXiv.2205.12454]

-

V. P. Dwivedi, L. Rampášek, M. Galkin, A. Parviz, G. Wolf, A. T. Luu, and D. Beaini, “Long Range Graph Benchmark,” Advances in Neural Information Processing Systems, vol. 35, pp. 22326–22340, December 2022.

[https://doi.org/10.5555/3600270.3601892]

-

P. Veličković, W. Fedus, W. L. Hamilton, P. Liò, Y. Bengio, and R. D. Hjelm, “Deep Graph Infomax,” in Proceedings of the International Conference on Learning Representations, May 2019.

[https://doi.org/10.48550/arXiv.1809.10341]

-

M. S. Hussain, M. J. Zaki, and D. Subramanian, “Global Self-Attention as a Replacement for Graph Convolution,” in Proceedings of the 28th ACM SIGKDD Conference on Knowledge Discovery and Data Mining, pp. 655–665, August 2022.

[https://doi.org/10.1145/3534678.3539296]

-

F. R. K. Chung, Spectral Graph Theory, American Mathematical Society, Providence, 1997.

[https://doi.org/10.1090/cbms/092]

-

A. Sandryhaila and J. M. F. Moura, “Discrete Signal Processing on Graphs: Graph Fourier Transform,” in Proceedings of the 2013 IEEE International Conference on Acoustics, Speech and Signal Processing, pp. 6167–6170, May 2013.

[https://doi.org/10.1109/ICASSP.2013.6638850]

-

D. A. Spielman and N. Srivastava, “Graph Sparsification by Effective Resistances,” in Proceedings of the 40th Annual ACM Symposium on Theory of Computing, pp. 563–568, May 2008.

[https://doi.org/10.1137/080734029]

- G. W. Stewart and J. G. Sun, Matrix Perturbation Theory, Academic Press, Boston, 1990.

-

Y. Dong, K. Ding, B. Jalaian, S. Ji, and J. Li, “AdaGNN: Graph Neural Networks with Adaptive Frequency Response Filter,” in Proceedings of the 30th ACM International Conference on Information & Knowledge Management, pp. 392–401, October 2021.

[https://doi.org/10.1145/3459637.3482226]

-

Z. Wu, B. Ramsundar, E. N. Feinberg, J. Gomes, C. Geniesse, A. S. Pappu, … and V. Pande, “MoleculeNet: A Benchmark for Molecular Machine Learning,” Chemical Science, vol. 9, no. 2, pp. 513–530, February 2018.

[https://doi.org/10.1039/C7SC02664A]

- B. Ramsundar, P. Eastman, P. Walters, and V. Pande, Deep Learning for the Life Sciences: Applying Deep Learning to Genomics, Microscopy, Drug Discovery, and More, O’Reilly Media, Sebastopol, CA, 2019.

-

X. Fang, L. Liu, J. Lei, D. He, S. Zhang, J. Zhou, … and H. Wang, “Geometry‑Enhanced Molecular Representation Learning for Property Prediction,” Nature Machine Intelligence, vol. 4, no. 2, pp. 127–134, February 2022.

[https://doi.org/10.1038/s42256-021-00438-4]

-

G. Zhou, Z. Gao, Q. Ding, H. Zheng, H. Xu, Z. Wei, … and G. Ke, “Uni‑Mol: A Universal 3D Molecular Representation Learning Framework,” ChemRxiv preprint, May 2022.

[https://doi.org/10.26434/chemrxiv-2022-jjm0j]

-

S. Feng, Y. Ni, M. Li, Y. Huang, Z.-M. Ma, W.-Y. Ma, and Y. Lan, “UniCorn: a unified contrastive learning approach for multi-view molecular representation learning,” Proceedings of the 41st International Conference on Machine Learning, Vienna, Austria, pp. 1–22, 2024.

[https://doi.org/10.5555/3692070.3692603]

-

J. H. Park, H. Park, Y. Kim, W. Lim, and S. Lee, “MoleCo: Molecular Contrastive Learning with Chemical Language Models for Molecular Property Prediction,” in Proceedings of the 2024 Conference on Empirical Methods in Natural Language Processing: Industry Track, pp. 408–420, November 2024.

[https://doi.org/10.18653/v1/2024.emnlp-industry.30]

- S. Kim, S. Oh, S. Lee, and J. Kim, “Moiré Graph Transformer: Eliminating Positional Encoding with Focused Attention,” OpenReview, 2025. https://openreview.net/forum?id=sJzfxRbEv6

-

R. Liao, Z. Zhao, R. Urtasun, and R. S. Zemel, “LanczosNet: Multi‑Scale Deep Graph Convolutional Networks,” arXiv preprint, January 2019.

[https://doi.org/10.48550/arXiv.1901.01484]

- 현재 : 성균관대학교 실감미디어공학과/소셜이노베이션융합전공 석사과정

- ORCID : https://orcid.org/0009-0003-9913-6871

- 주관심분야 : Gnn, Bioinformatics, Drug Discovery

- 현재:성균관대학교 소프트웨어학과 박사과정

- ORCID : https://orcid.org/0000-0002-7681-7987

- 주관심분야 : Gnn, Network Science, Bioinformatics

- 현재 : 성균관대학교 글로벌융합학부 인공지능융합전공/소프트웨어학과/데이터사이언스융합학과/소셜이노베이선융합전공/실감미디어공학과/소비자학과 부교수

- 한국지능시스템학회, 한국방송‧미디어공학회 종신회원

- ACM / IEEE 정회원

- ORCID : https://orcid.org/0000-0001-5174-0074

- 주관심분야 : Recommender System, Genetic Algorithm, Pattern Analysis