특성 정밀도 향상에 따른 딥러닝 기반 포인트 클라우드 압축 기술 성능 분석 연구

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

포인트 클라우드는 3차원 물체나 장면을 표현하는 방식으로 방대한 크기를 가지고 있어, 최근 효율적인 포인트 클라우드 압축 기술에 대한 필요성이 커지고 있다. 이에, 국제 표준화 기구 MPEG(Moving Picture Experts Group)에서는 기존의 신호처리 기반 방식 대비 우수한 압축 성능을 보이는 딥러닝 기반 포인트 클라우드 압축 기술에 대해 표준화를 진행 중이며, 현재 이를 위한 참조 소프트웨어인 TMAP(Test Model for AI-based Point Cloud Compression)을 개발하고 있다. TMAP은 포인트 클라우드를 입력으로 받아 잠재 공간으로 변환하고, 변환된 특성을 엔트로피 코딩을 통해 비트스트림으로 부호화하는 구조를 가진다. 이때 엔트로피 코딩 내 양자화를 통해 소수점 이하의 특성 정보는 소실되며, 이는 포인트 복원을 위한 복호화된 특성의 표현력을 저하할 수 있다. 이에 본 논문에서는 양자화 이전 스케일링을 통해 복호화된 특성의 표현력을 향상시켜, 특성의 정밀도 향상이 비트스트림 크기 및 PSNR과 같은 압축 성능 지표에 미치는 영향을 실험적으로 분석한다.

Abstract

Due to the massive size of point cloud data that represent a 3D object or scene, the need for efficient point cloud compression techniques has been increasing. Accordingly, the international standards body MPEG(Moving Picture Experts Group) is standardizing deep learning-based point cloud compression, which shows superior compression performance compared to existing signal processing based approaches, and is developing TMAP(Test Model for AI-based Point Cloud Compression) as the reference software. TMAP takes a point cloud as input, transforms it to a latent space, and encodes the transformed features into a bitstream through entropy coding. During this process, quantization within the entropy-coding leads to the loss of fractional feature information, which can reduce the expressiveness of the decoded features for point reconstruction. To address this, this paper enhances the expressiveness of decoded feature through scaling before quantization and analyzes the impact of enhanced feature precision on compression performance metrics like bitstream and PSNR.

Keywords:

Point Cloud Compression, Feature Precision, Scaling, Deep LearningⅠ. 서 론

포인트 클라우드는 3차원 물체나 장면을 표현하는 방식 중 하나로, 자율주행, 증강/가상현실(AR/VR) 등 다양한 산업 분야에서 널리 활용되고 있다[1][2]. 이러한 포인트 클라우드 데이터는 RGB-D 카메라 및 LiDAR(Light Detection and Ranging) 센서를 통해 획득된 다수의 점으로 구성되며[3][4], 각 점은 3차원 위치를 나타내는 기하 정보와 색상 또는 반사도를 표현하는 속성 정보를 포함한다. 포인트 클라우드 데이터는 수많은 점으로 구성되어 있어 2차원 이미지/비디오 데이터 대비 방대한 크기를 가지고 있고[5], 이에 따라 포인트 클라우드 데이터의 저장, 전송 및 실시간 처리를 위한 효율적인 포인트 클라우드 압축 기술의 필요성이 커지고 있다.

이에, 국제 표준화 기구 ISO/IEC JTC 1/SC 29 산하의 MPEG WG 7에서는 포인트 클라우드를 2차원 패치(Patch)로 투영한 후 기존 비디오 코덱을 활용하는 V-PCC (Video-based Point Cloud Compression) 압축 기술[6][7][8]과 포인트 클라우드의 3차원 분포 특성을 활용하여 압축하는 G-PCC(Geometry-based Point Cloud Compression) 압축 기술[9][10]에 대해 표준화를 진행해 왔다. 최근에는 앞선 신호처리 기반 압축 방식보다 우수한 성능을 보여주고 있는 딥러닝 기반 포인트 클라우드 압축 기술에 대한 표준화를 AI-GC(Artificial Intelligence-based Graphics Coding) 그룹 내에서 수행하고 있고[11][12][13], 이를 위한 참조 소프트웨어인 TMAP을 개발하고 있다[14][15].

TMAP은 포인트 클라우드를 입력으로 받아 인공신경망을 통해 잠재 공간(Latent Space) 내 특성 정보(Feature)로 변환하고, 변환된 특성 정보를 엔트로피 코딩(Entropy Coding) 과정을 통해 비트스트림으로 부호화한다. 이때, 엔트로피 코딩 과정 내 양자화 과정은 입력 특성 정보의 소수점 이하 정보들을 소실되게 만들고, 이는 복호화 단에서 복호화된 특성 정보의 소수점 이하 정보 또한 소실되게 만들어, 이후 포인트의 점유 여부에 대한 확률 예측 과정 또는 복원 과정에 활용되는 복호화된 특성 정보의 표현력을 저하할 수 있다[16]. 이에 본 논문에서는 양자화 이전 스케일링(Scaling)을 통해 특성 정보의 정밀도를 높여 이들을 부호화하여 복호화된 특성의 표현력을 향상시키고, 특성 정보의 정밀도 향상이 비트스트림 크기 및 PSNR(Peak Signal to Noise Ratio)[17]과 같은 압축 성능 지표에 미치는 영향을 실험적으로 분석한다.

Ⅱ. 배경 기술

본 논문에서 적용할 스케일링 기반 특성 정밀도 향상 방안은 딥러닝 기반 포인트 클라우드 압축 기술을 위한 참조 소프트웨어인 TMAP을 바탕으로 적용되었다. 이에 본 논문의 원활한 이해를 위해, 본 장에서는 TMAP의 부/복호화기 구조와 그 방법을 소개한다.

1. TMAP 구조

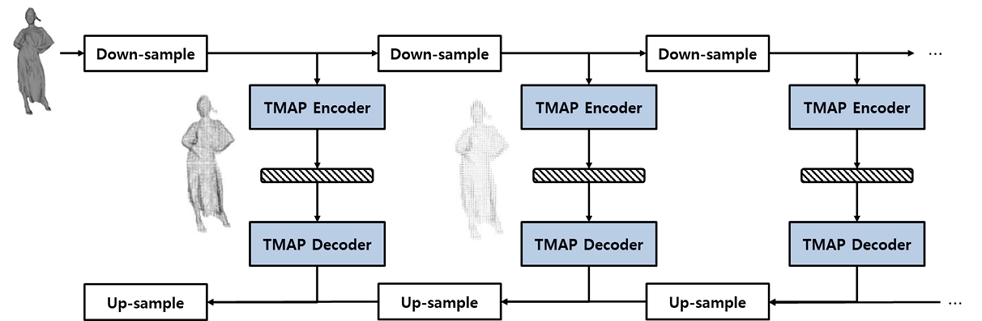

TMAP의 전체 부/복호화기 구조[18]는 계층적으로 구성되며, 이는 그림 1에서 확인할 수 있다. 먼저 입력 포인트 클라우드는 다운샘플링(Down-sample) 및 업샘플링(Up-sample) 모듈을 통해 여러 해상도에서 표현되고, 각 해상도의 포인트 클라우드는 해당 계층에서의 TMAP 부/복호화기를 통해 부호화 및 복호화된다. 이때, 각 계층에서의 부호화 및 복호화 과정은 가장 낮은 해상도(계층)에서 시작되며, 점차 높은 해상도의 포인트 클라우드를 복원하고, 결과적으로 입력 포인트 클라우드와 같은 해상도의 포인트 클라우드가 재생성된다. 이에 따라, TMAP의 전체 비트스트림은 각 계층에서 부호화된 비트스트림들로 구성되게 된다.

2. TMAP 부/복호화기 방식

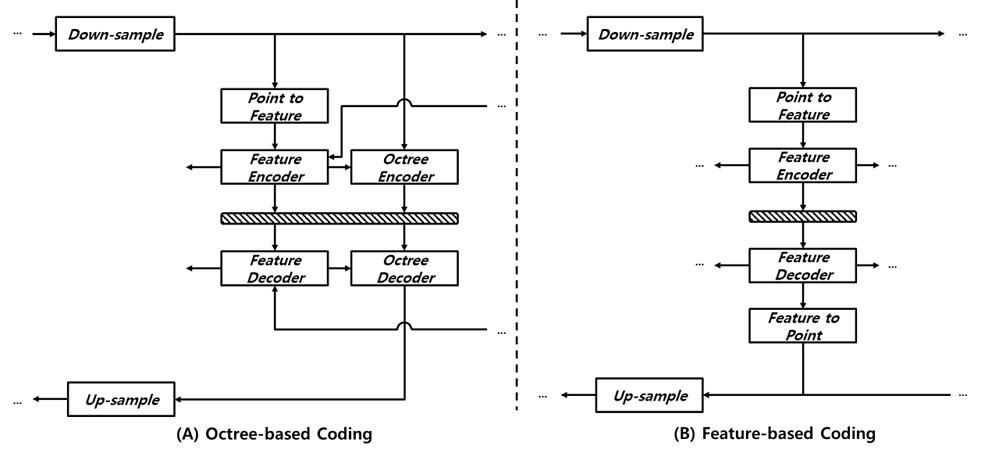

본 장의 1절에서 언급했듯이, TMAP은 계층적인 구조를 가지며, 각 계층에서는 다운샘플링된 포인트 클라우드를 부호화 및 복호화한다. 이때, TMAP의 계층별 부/복호화 과정[18]은 그림 2에 나타나 있는, Octree-based Coding 방식과 Feature-based Coding 방식 중 한 가지를 통해 수행된다. 먼저 그림 2의 (A) Octree-based Coding 방식은 현재 계층의 다운샘플링된 포인트 클라우드를 Point to Feature 모듈 내 인공신경망을 활용하여 잠재 공간 내 특성 정보로 변환한다. 변환된 특성 정보는 Feature Encoder 모듈을 통해 비트스트림으로 부호화되며, 동시에 Octree Encoder 모듈에서 현재 계층의 포인트 클라우드 점유 정보에 대한 확률 예측 과정을 위해 활용된다. 이후, Octree Encoder 모듈에서는 특성 정보를 활용하여 예측된 확률을 기반으로, 현재 계층의 포인트 클라우드에 대한 점유 정보를 산술 부호화(Arithmetic Encoding) 과정을 통해 비트스트림으로 부호화한다. 결과적으로 현재 계층에서 Octree-based Coding 방식이 사용될 경우, 현재 계층의 전체 비트스트림은 특성 정보에 대한 비트스트림과 점유 정보에 대한 비트스트림으로 구성된다. 복호화 단에서는 앞선 두 가지 비트스트림을 입력받으며, 이 중 특성 정보에 대한 비트스트림은 Feature Decoder 모듈을 통해 복호화된 특성 정보를 생성한다. 복호화된 특성 정보는 부호화 단에서와 동일하게 현재 계층의 포인트 클라우드 점유 정보에 대한 확률 예측 과정에 활용되며, Octree Decoder 모듈에서는 점유 정보에 대한 비트스트림과 예측된 확률을 기반으로 산술 복호화(Arithmetic Decoding) 과정을 통해 현재 계층의 점유 정보를 복원하게 된다. 이를 통해 Octree-based Coding 방식은 무손실 압축 방식으로 동작한다. 반면, 그림 2의 (B) Feature-based Coding 방식은 Point to Feature 모듈 내 인공신경망을 활용하여 현재 계층의 다운샘플링된 포인트 클라우드를 특성 정보로 변환하고, Feature Encoder 모듈을 통해 변환된 특성 정보만을 비트스트림으로 부호화한다. 이에 따라, 복호화 단에서는 특성 정보에 대한 비트스트림만을 입력받으며, Feature Decoder 모듈을 통해 복호화된 특성 정보만을 생성한다. 이후, Feature to Point 모듈은 복호화된 특성 정보를 기반으로 인공신경망을 활용하여 점유 확률이 높은 포인트들을 복원하는 방식으로 현재 계층의 포인트 클라우드를 재생성한다. 이 때문에, Feature-based Coding 방식은 손실 압축 방식으로 동작한다. 정리하자면, TMAP의 무손실 압축 환경은 모든 계층에서 Octree-based Coding 방식을 사용하는 것으로 실현되며, 손실 압축 환경의 경우, 특정 계층까지는 Octree-based Coding 방식, 이후 남은 계층에 대해서는 Feature-based Coding 방식을 활용하게 된다.

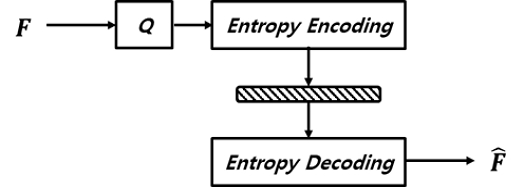

앞서 소개한 것처럼, Octree-based Coding 방식과 Feature-based Coding 방식은 모두 Feature Encoder 모듈을 통해 특성 정보에 대한 비트스트림을 생성한다. 이때, 특성 정보는 엔트로피 코딩 과정을 통해 비트스트림으로 부호화되며, 그림 3은 Feature Encoder 모듈의 엔트로피 코딩 과정의 내부 구조를 묘사한다. 그림 3의 엔트로피 코딩 과정에 입력으로 들어오는 특성 정보(F)는 반올림 방식을 통한 균일 양자화(Q) 과정을 수행하고, 엔트로피 부호화 과정을 통해 비트스트림으로 부호화된다. 이후, 복호화 단에서는 엔트로피 복호화 과정을 통해 복호화된 특성 정보()를 생성한다. 이 과정에서, 입력 특성 정보는 양자화 과정으로 인해 소수점 이하의 정보들을 소실할 가능성이 크고, 이는 포인트의 점유 여부에 대한 확률 예측 과정 또는 복원 과정에 활용되는 복호화된 특성 정보의 소수점 이하 정보 손실을 야기하여, 복호화된 특성 정보의 표현력을 저하할 수 있다.

이에, 양자화 과정에서의 정보 손실을 줄여 표현력이 향상된 특성 정보가 포인트의 점유 여부에 대한 확률 예측 과정 또는 복원 과정에 얼마나 기여할 수 있는지를 분석하기 위해, 스케일링 기반 특성 정밀도 향상 방안을 다음 장에서 소개한다.

Ⅲ. 스케일링 기반 특성 정밀도 향상 방법

Ⅱ장에서 설명했듯이, 특성 정보는 엔트로피 코딩 과정을 거치면서 소수점 이하의 정보들을 소실하고, 이는 포인트 점유 여부에 대한 확률 예측 과정 또는 복원 과정에 활용되는 복호화된 특성 정보의 표현력을 저하할 수 있다. 이에, 본 장에서는 표현력이 향상된 특성 정보가 포인트의 점유 여부 확률 예측 과정 또는 복원 과정에 얼마나 기여할 수 있는지의 분석을 진행하기 위한 실험 설계 방안으로 스케일링 기반 특성 정밀도 향상 방법을 소개한다.

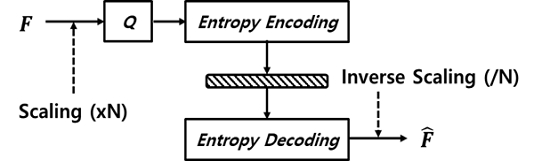

그림 4는 스케일링 기반 특성 정밀도 향상 방법의 구조도를 보여준다. 그림 4의 입력으로 들어가는 특성 정보(F)는 특정 스케일링 수치(N)와의 곱 연산을 통해 증폭되며, 양자화 및 엔트로피 부호화 과정을 수행하며 비트스트림으로 부호화된다. 복호화 단에서는 엔트로피 복호화 과정을 통해 복호화된 특성 정보에 대해 부호화 단에서 사용하였던 스케일링 수치(N)와의 나누기 연산을 적용하여 복호화된 특성 정보()를 생성한다. 이를 통해, 복호화된 특성 정보는 기존 입력 특성 정보의 소수점 이하 정보들을 일정 정도 보존할 수 있으며, 스케일링 수치에 비례하여 정밀도가 향상될 수 있다. 결과적으로 표현력이 향상된 복호화된 특성 정보를 활용함으로써, 포인트의 점유 여부에 대한 확률 예측 과정 또는 복원 과정을 보다 정확하게 수행할 가능성이 크다.

Ⅳ. 실험 결과

본 장에서는 Ⅲ장에서 소개한 스케일링 기반 특성 정밀도 향상 방법을 통해, 표현력이 향상된 특성 정보가 포인트의 점유 여부 확률 예측 과정 또는 복원 과정에 얼마나 기여할 수 있는지를 파악하기 위해, 특성 정보의 정밀도 향상이 비트스트림 크기 및 PSNR과 같은 압축 성능 지표에 미치는 영향을 실험적으로 분석한다.

1. 실험 데이터셋 및 구성 환경

본 실험에서는 데이터셋으로 AI-PCC CTC(Common Test Condition)[19]에 정의된 RWTT 콘텐츠와 Static 콘텐츠를 사용하였으며, 기반 모델로 딥러닝 기반 포인트 클라우드 압축 모델인 TMAPv1[15]을 활용하였다. 실험 환경으로는 기하 정보 무손실 압축 환경을 지원하는 T3 실험 환경[19]과 기하 정보 손실 압축 환경을 지원하는 T1 실험 환경[19] 아래에서 실험을 진행하였다. 추가로, 손실 압축 환경 실험에서는 TMAP의 Rate Control Parameter 중 다양한 비트레이트(Bitrate)를 지원하기 위해 사용되는 lambda 파라미터[19]를 변경해가며 결과를 분석하였다. TMAP의 lambda 파라미터는 여러 TMAP 모듈 내 특성 정보의 정규화 과정에 사용되며, 작은 lambda 값이 사용될 경우 왜곡 정도를 줄이는 것이 우선되고, 반대의 경우 비트레이트를 줄이는 역할을 한다.

2. 무손실 압축 환경(T3) 실험 결과 및 분석

무손실 압축 환경에서는 특성 정보의 정밀도 향상이 포인트의 확률 예측 과정에 미치는 영향을 세밀하게 분석하기 위해, 특성 정보의 분포에 따라 스케일링 수치(N) 1.0(원본), 2.0, 10.0, 50.0, 100.0에서 실험을 진행하였다. 표 1은 RWTT 콘텐츠의 스케일링 수치에 따른 원본 대비 점유 정보 및 특성 정보 비트스트림 크기 비율을 나타낸다. 이때 점유 정보 및 특성 정보의 원본 대비 비트스트림 크기 비율은 특정 스케일링 수치를 기반으로 제안 방법을 적용하여 얻은 비트스트림의 크기에서 원본 비트스트림의 크기를 빼고, 해당 값을 원본 비트스트림의 크기로 나누어준 값이다. 표 1을 통해 RWTT 콘텐츠 내 RWTT_059_tomb_vox10, RWTT_156_vishnu_vox10, RWTT_211_foxstatue_vox10 모든 시퀀스에서, 스케일링 수치가 증가할수록 점유 정보 비트스트림 크기 비율은 감소하고 특성 정보 비트스트림 크기 비율은 증가하는 것을 관측할 수 있다. 또한, 모든 시퀀스에서 점유 정보 비트스트림 크기 비율의 감소 폭은 스케일링 수치가 커짐에 따라 줄어들었으나, 특성 정보 비트스트림 크기 비율의 증가 폭은 기하급수적으로 증폭되었다. 특히 RWTT_211_foxstatue_vox10 시퀀스의 경우, 스케일링 수치가 100일 때의 특성 정보 비트스트림 크기 증가 비율이 스케일링 수치가 50일 때보다 약 2.7배 증가되었다.

표 2와 3은 RWTT 콘텐츠의 스케일링 수치에 따른 복호화된 특성 정보의 분산 및 엔트로피[20]를 보여준다. 표 2, 3을 통해 모든 시퀀스에서 스케일링 수치가 증가함에 따라 복호화된 특성 정보의 분산 및 엔트로피가 평균적으로 증가하는 경향을 확인할 수 있다. 이때, 복호화된 특성 정보의 분산 증가 폭은 앞선 점유 정보 비트스트림 크기 비율의 감소 폭과 유사한 포화 현상을 보여주었으며, 복호화된 특성 정보의 엔트로피는 앞선 특성 정보 비트스트림 크기 비율의 증가 폭과 유사한 급격한 증가 폭이 관측되었다. 특히, 표 3에서 RWTT_211_foxstatue_vox10 시퀀스의 스케일링 수치가 100일 때의 복호화된 특성 정보의 엔트로피는 스케일링 수치가 50일 때 엔트로피 수치 대비 약 2.3배 증가했으며, 이는 같은 조건의 다른 시퀀스 RWTT_059_tomb_vox10, RWTT_156_vishnu_vox10보다 큰 증가 폭을 보여주었다.

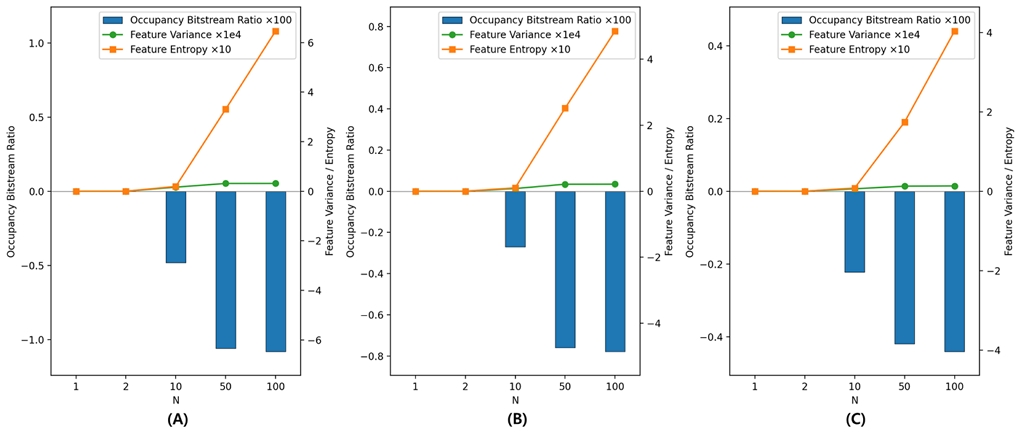

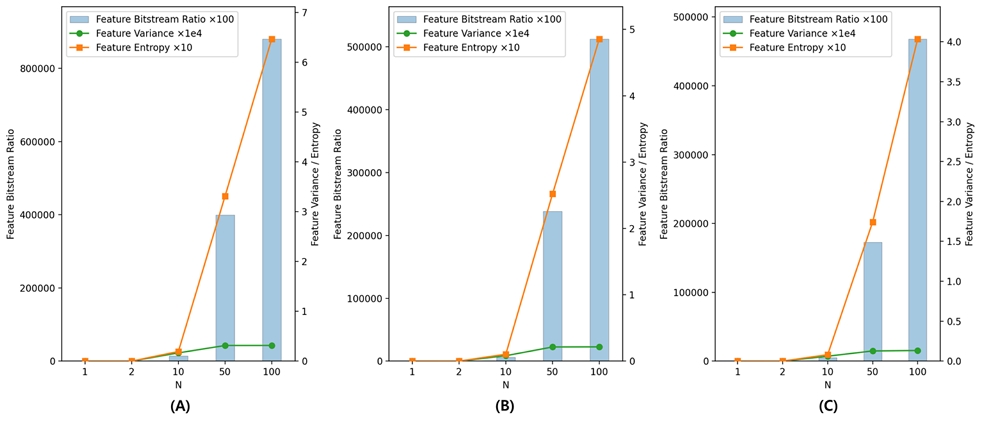

그림 5와 6은 표 1, 2, 3의 스케일링 수치에 따른 점유/특성 정보 비트스트림 크기 비율과 복호화된 특성 정보의 분산 및 엔트로피를 그래프로 나타낸 것이다. 표 1, 2, 3 및 그림 5를 통해 복호화된 특성 정보의 분산 및 엔트로피가 증가한 스케일링 수치에 대해서만 점유 정보 비트스트림의 크기 비율이 감소하는 것을 확인할 수 있다. 이는, 일정 임계치 이상의 스케일링 수치가 적용되었을 때, 복호화된 특성 정보의 소수점 이하 정보가 보존되고 이에 따라 복호화된 특성 정보의 분산 및 엔트로피가 증가할 수 있다고 예상된다. 이처럼, 표현력이 향상된 특성 정보를 기반으로 포인트의 점유 정보에 대한 확률 예측 과정을 보다 정밀하게 수행함으로써, 점유 정보에 대한 산술 부호화 과정의 효율을 높이고, 결과적으로 점유 정보에 대한 비트스트림 크기를 줄인 것으로 분석할 수 있다. 요약하자면, 스케일링 기반 특성 정밀도 향상 방안은 복호화된 특성 정보의 분산 및 엔트로피를 증가시킬 수 있는 일정 임계치 이상의 스케일링 수치에 대해서만 점유 정보 비트스트림의 크기를 줄일 수 있는 것으로 분석된다.

Occupancy information bitstream size ratio to the anchor and variance/entropy of decoded feature information depending on N: (A) RWTT_059_tomb_vox10; (B) RWTT_156_vishnu_vox10; (C) RWTT_211_foxstatue_vox10

Feature information bitstream size ratio to the anchor and variance/entropy of decoded feature information depending on N: (A) RWTT_059_tomb_vox10; (B) RWTT_156_vishnu_vox10; (C) RWTT_211_foxstatue_vox10

추가로, 그림 5에서 스케일링 수치가 커짐에 따라 점유 정보 비트스트림의 크기 비율 감소 폭과 복호화된 특성 정보의 분산 증가 폭은 일정 값으로 포화되는 경향을 관측할 수 있다. 이러한 포화 경향은 아래와 같이 분석된다. 먼저, 스케일링 수치가 커짐에 따라 복호화된 특성 정보는 특정 소수점 자리 이하의 정보들만을 추가로 가지게 된다. 하지만 보다 정밀해진 특성 정보의 소수점 이하 정보들은 평균을 기반으로 얼마나 펴져 있는지를 수치화하는 분산에는, 그 크기가 매우 작아 큰 영향을 미칠 수 없다. 이에 따라, 복호화된 특성 정보의 분산은 스케일링 수치가 커짐에 따라 일정 값으로 포화되는 것으로 분석된다. 또한, 점유 정보 비트스트림 크기 비율의 경우, 높은 스케일링 수치가 적용됨에 따라 복호화된 특성 정보의 정밀도도 향상되지만, 특정 소수점 이하의 정밀도 및 표현력 향상이 더는 점유 정보 비트스트림 크기 감소에 유의미한 영향을 미치지 못하여, 일정 수준 이상의 효과가 제한되는 포화 구간이 관측된다고 판단된다.

한편, 그림 6에서는 스케일링 수치가 증가할수록, 특성 정보에 대한 비트스트림 크기 비율과 복호화된 특성 정보의 엔트로피가 급격히 증가하는 것을 확인할 수 있다. 복호화된 특성 정보의 엔트로피의 경우, 특성 정보의 정밀도가 높아짐에 따라 더욱 다양한 소수점 이하의 정보들을 가지기 때문에, 엔트로피가 급격히 증가하는 것으로 분석된다. 동시에, 엔트로피가 높아진 특성 정보가 TMAP의 엔트로피 코딩 과정에 입력으로 들어감에 따라 엔트로피 코딩 과정의 효율이 낮아져, 출력되는 특성 정보에 대한 비트스트림 크기 비율이 증가한 것으로 판단된다.

표 4, 5, 6은 Static 콘텐츠에 대한 스케일링 수치에 따른 점유 정보 및 특성 정보 비트스트림 크기 비율과 복호화된 특성 정보의 분산 및 엔트로피 정도를 나타낸다. 표 4를 통해, Static 콘텐츠의 모든 시퀀스에서 스케일링 수치가 증가함에 따라 점유 정보 비트스트림 크기 비율은 감소하고 특성 정보 비트스트림 크기 비율은 증가하는 것을 알 수 있고, 이는 RWTT 콘텐츠와 유사한 경향을 보여주었다. 표 5, 6에서도 RWTT 콘텐츠와 유사하게, 스케일링 수치가 커질수록 복호화된 특성 정보의 분산 및 엔트로피가 평균적으로 증가하는 경향이 확인되었다.

그림 7, 8은 표 4, 5, 6의 스케일링 수치에 따른 점유/특성 정보 비트스트림 크기 비율과 복호화된 특성 정보의 분산 및 엔트로피를 그래프로 나타낸 것이다. 표 4, 5, 6과 그림 7을 통해, Static 콘텐츠에서도 복호화된 특성 정보의 분산 및 엔트로피가 증가한 스케일링 수치에 대해서만 점유 정보 비트스트림의 크기가 감소하는 것을 확인할 수 있다. 즉, 앞선 RWTT 콘텐츠의 결과와 Static 콘텐츠의 결과를 기반으로, 본 논문에서 적용한 스케일링 기반 특성 정밀도 향상 방안이 복호화된 특성 정보의 표현력을 향상시켰고, 이를 통해 포인트의 점유 정보에 대한 확률 예측 과정을 보다 정확하게 수행함으로써, 소모되는 점유 정보 비트스트림의 크기를 줄인 것으로 분석할 수 있다.

Occupancy information bitstream size ratio to the anchor and variance/entropy of decoded feature information depending on N: (A) Arco_Valentino_Dense_vox12; (B) Facade_00009_vox12; (C) House_without_roof_00057_vox12; (D) Shiva_00035_vox12; (E) Statue_Klimt_vox12

Feature information bitstream size ratio to the anchor and variance/entropy of decoded feature information depending on N: (A) Arco_Valentino_Dense_vox12; (B) Facade_00009_vox12; (C) House_without_roof_00057_vox12; (D) Shiva_00035_vox12; (E) Statue_Klimt_vox12

또한, 점유 정보 비트스트림 크기 비율 및 복호화된 특성 정보의 분산에 대한 포화 경향이나, 특성 정보 비트스트림의 크기 비율 및 복호화된 특성 정보의 엔트로피에 대한 급격한 증가 경향도 RWTT 콘텐츠와 유사한 경향성을 보여주었다. 이를 통해, 본 논문에서 적용한 스케일링 기반 특성 정밀도 향상 방안이 복호화된 특성 정보의 분산 수치를 포화시키는 임계치 이상의 스케일링 수치를 사용할 경우, 점유 정보 비트스트림 크기 감소에 더는 유의미한 영향을 미치지 못한다고 추론할 수 있다.

한 가지 RWTT 콘텐츠와의 차이점으로, 표 1, 4에서 스케일링 수치가 10일 때, Static 콘텐츠의 Statue_Klimt_vox12 시퀀스에서 감소하는 점유 정보 비트스트림 크기 비율이 RWTT 콘텐츠의 RWTT_059_tomb_vox10 시퀀스 대비 약 1,600배 작은 결과를 포함하여, 평균적으로 Static 콘텐츠의 점유 정보 비트스트림 크기 감소 비율이 RWTT 콘텐츠보다 작은 것을 확인할 수 있다. 이는 표 2, 3, 5, 6을 통해 같은 스케일링 수치를 적용하였음에도, 분산 및 엔트로피의 증가 수치가 Static 콘텐츠에서 더 작은 결과를 보였기 때문에, 더 적은 점유 정보 비트스트림 크기 감소 수치가 관측되었다고 판단된다. 이를 통해, 콘텐츠마다 입력 특성 정보의 분포가 상이한 것을 기반으로, 스케일링 기반 특성 정밀도 향상 방안을 위한 스케일링 수치는 콘텐츠별 복호화된 특성 정보의 분산 및 엔트로피를 충분히 증가시킬 수 있는 값으로 설정되어야 할 것으로 분석된다.

3. 손실 압축 환경(T1) 실험 결과 및 분석

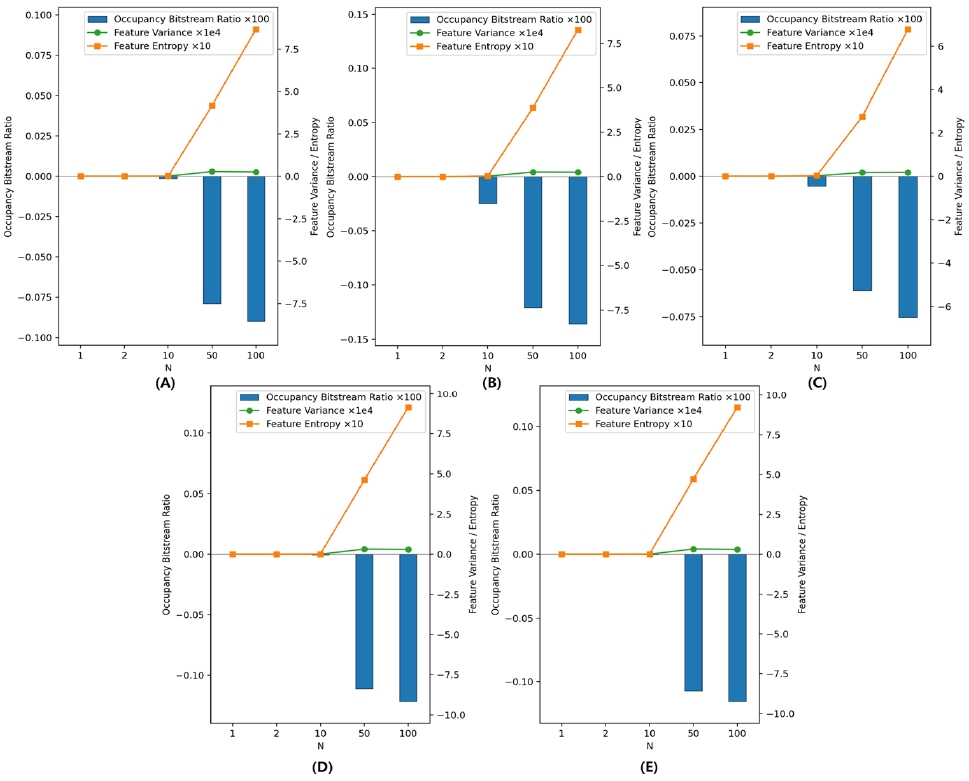

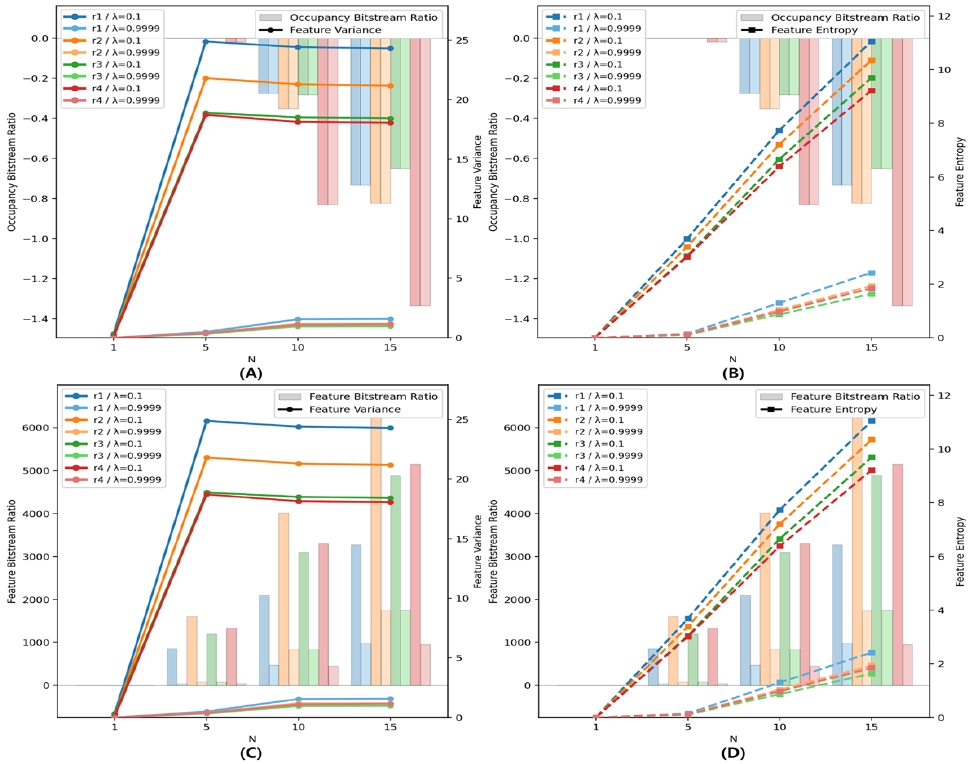

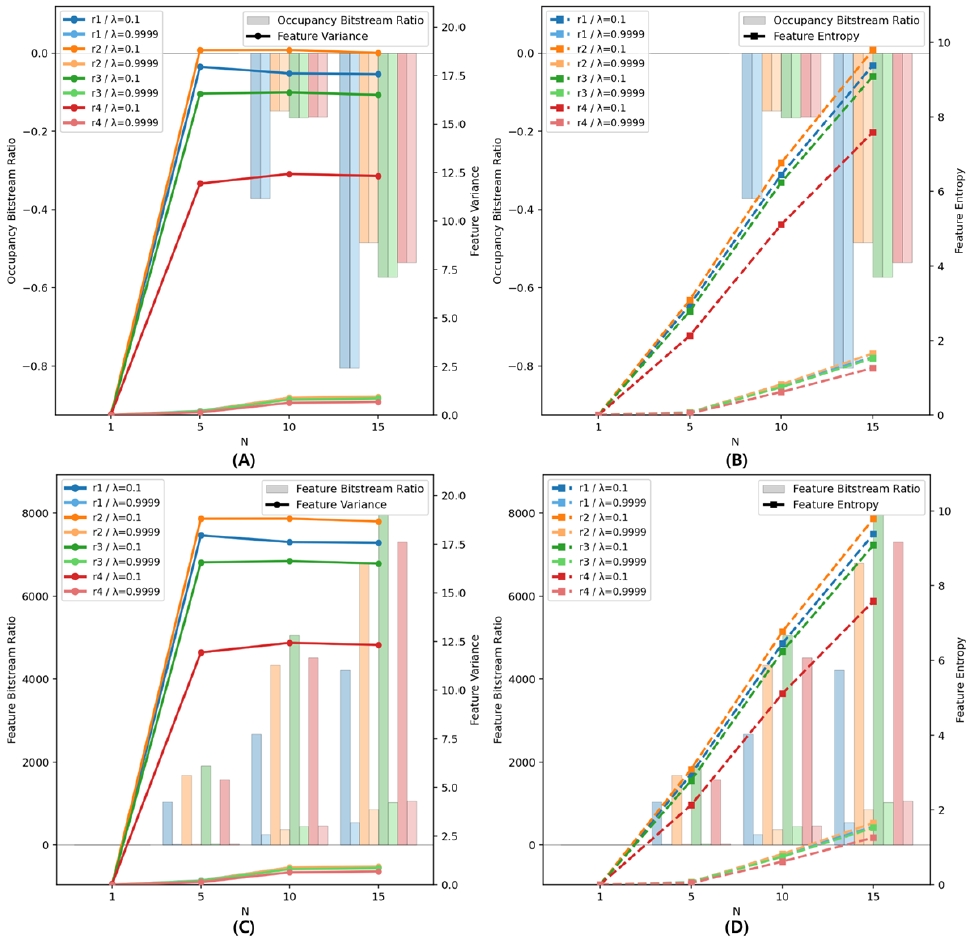

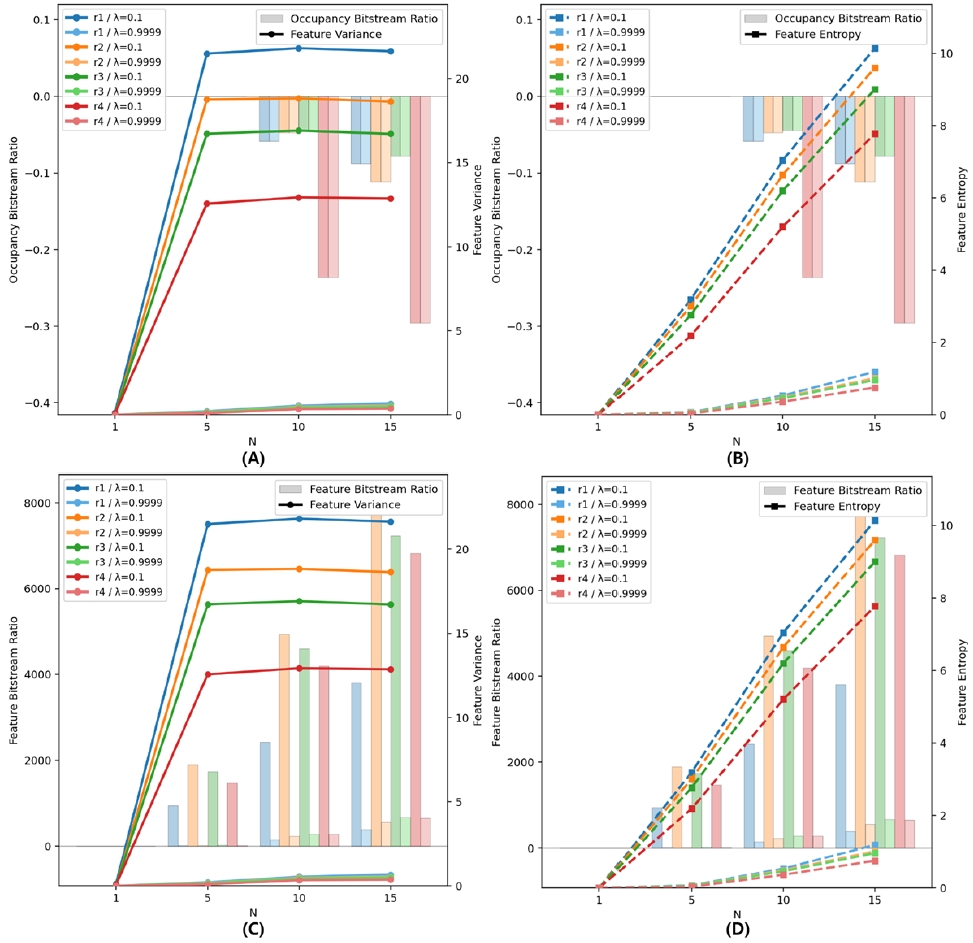

손실 압축 환경에서는 복호화된 특성 정보의 분산 및 엔트로피를 적절히 조절하여 비트스트림 크기 및 PSNR 결과를 분석하기 위해, RWTT 콘텐츠의 경우 스케일링 수치 1.0(원본), 5.0, 10.0, 15.0을 사용하였으며, Static 콘텐츠의 경우 1.0(원본), 1.2, 1.6, 2.0을 사용하여 실험을 진행하였다. 그림 9, 10, 11은 각각 RWTT_059_tomb_vox10, RWTT_156_vishnu_vox10, RWTT_211_foxstatue_vox10 시퀀스에 대한, 스케일링 수치에 따른 rate 및 lambda별 점유/특성 정보 비트스트림 크기 비율과 복호화된 특성 정보의 분산 및 엔트로피를 그래프로 표현한 것이다. 먼저 그림 9, 10, 11을 통해 모든 rate 및 lambda 값에 따른 실험 결과에서, 무손실 압축 환경 실험 결과에서 나타났던 것처럼, 스케일링 수치가 증가함에 따라 점유 정보 비트스트림의 크기 비율은 줄어들고 특성 정보 비트스트림 크기 비율은 증가하는 것을 확인할 수 있다. 또한, 스케일링 수치가 증가할수록, 복호화된 특성의 분산 및 엔트로피가 평균적으로 증가하는 경향도 앞선 무손실 압축 환경의 실험 결과와 유사하게 관측되었다.

RWTT_059_tomb_vox10 sequence: (A) occupancy information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (B) occupancy information bitstream size ratio to the anchor and entropy of decoded feature information depending on N; (C) feature information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (D) feature information bitstream size ratio to the anchor and entropy of decoded feature information depending on N

RWTT_156_vishnu_vox10 sequence: (A) occupancy information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (B) occupancy information bitstream size ratio to the anchor and entropy of decoded feature information depending on N; (C) feature information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (D) feature information bitstream size ratio to the anchor and entropy of decoded feature information depending on N

RWTT_211_foxstatue_vox10 sequence: (A) occupancy information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (B) occupancy information bitstream size ratio to the anchor and entropy of decoded feature information depending on N; (C) feature information bitstream size ratio to the anchor and variance of decoded feature information depending on N; (D) feature information bitstream size ratio to the anchor and entropy of decoded feature information depending on N

한편, 그림 9, 10, 11의 (A), (B)를 통해, 모든 rate의 실험 결과에서 복호화된 특성 정보의 분산 및 엔트로피가 더 작은 lambda 값이 사용되었을 때 더 많이 증가했음에도 불구하고, lambda 값에 따른 점유 정보 비트스트림의 크기 비율에 대한 변화는 관측되지 않았다. 이는 기존의 특성 정보 분산 및 엔트로피가 증가하면 점유 정보 비트스트림의 크기는 감소한다는 예상과 상반되는 실험 결과이다. 이에 대한 분석은 다음과 같다. 앞선 Ⅱ장의 2절에서, 손실 압축 환경은 특정 계층까지는 포인트의 점유 확률 예측 과정을 활용하는 Octree-based Coding 방식을 사용하고, 남은 계층에 대해서는 Feature-based Coding 방식을 적용한다고 소개하였고, 점유 정보 비트스트림의 크기 비율은 Octree-based Coding 방식이 활용되는 계층에 대해서만 존재하고 영향받는다. 그러나 현재 그림 9, 10, 11의 (A), (B)에 묘사된 복호화된 특성 정보의 분산 및 엔트로피는 모든 계층의 특성 정보를 기반으로 계산된 결과이다. 즉, Octree-based Coding 방식을 사용하는 계층에 대한 특성 정보와 Feature-based Coding 방식을 활용하는 계층에 대한 특성 정보가 같이 집계되었기 때문에, 기존의 특성 정보 분산 및 엔트로피가 증가에 따른 점유 정보 비트스트림의 크기 감소 경향이 관측되지 않은 것으로 분석된다.

반면, 그림 9, 10, 11의 (C), (D)를 통해, 특성 정보 비트스트림 크기는 lambda 값에 따른 변화가 관측되었다. 모든 rate의 결과에서 더 작은 lambda 값이 사용되었을 때 복호화된 특성 정보의 엔트로피가 더 많이 증가했으며, 이러한 증가 결과가 비효율적인 엔트로피 코딩 부호화 과정을 야기하여 특성 정보에 대한 비트스트림 크기가 증가한 것으로 추론된다.

추가로, rate별 실험 결과 측면에서는 일정한 경향이 관측되지 않았다. 그림 9의 RWTT_059_tomb_vox10 시퀀스에서는 모든 스케일링 수치에서 rate 1이 가장 큰 분산 및 엔트로피 증가세를 보여주었지만, 감소된 점유 정보 비트스트림 크기는 평균적으로 rate 4가, 증가된 특성 정보 비트스트림의 크기 비율은 평균적으로 rate 2에서 가장 큰 변화가 관측되었다. 이는 그림 10의 RWTT_156_vishnu_vox10 시퀀스, 그림 11의 RWTT_211_foxstatue_vox10 시퀀스에서도 동일하게, rate에 따른 일정한 경향은 확인되지 않았다.

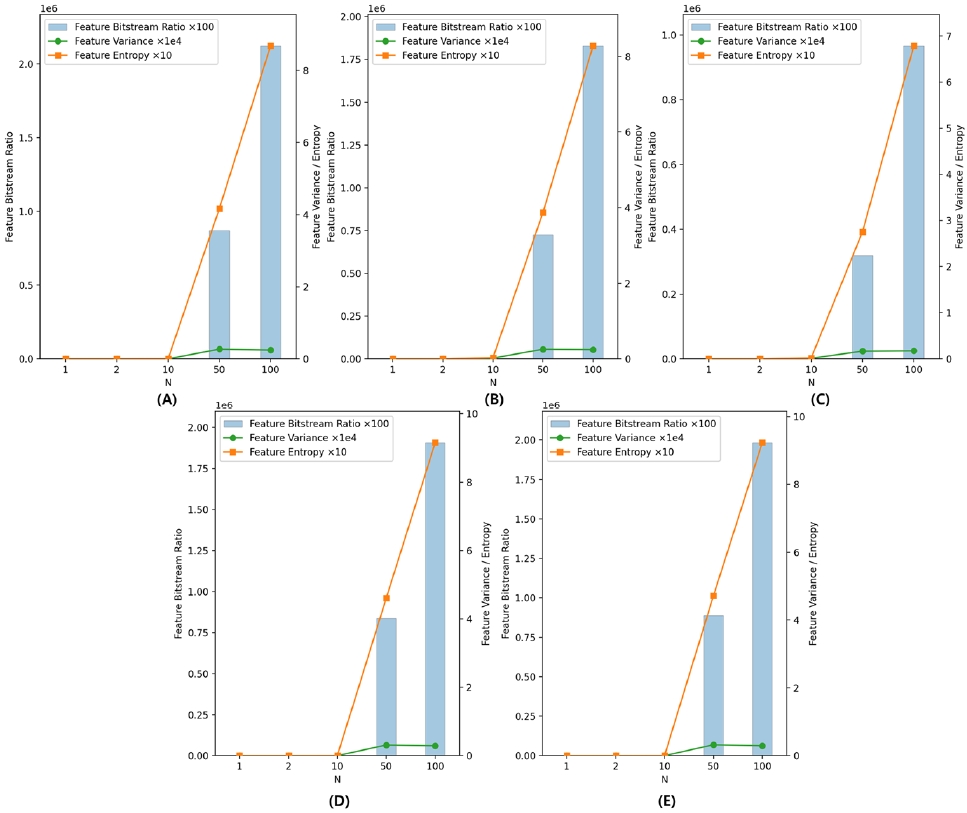

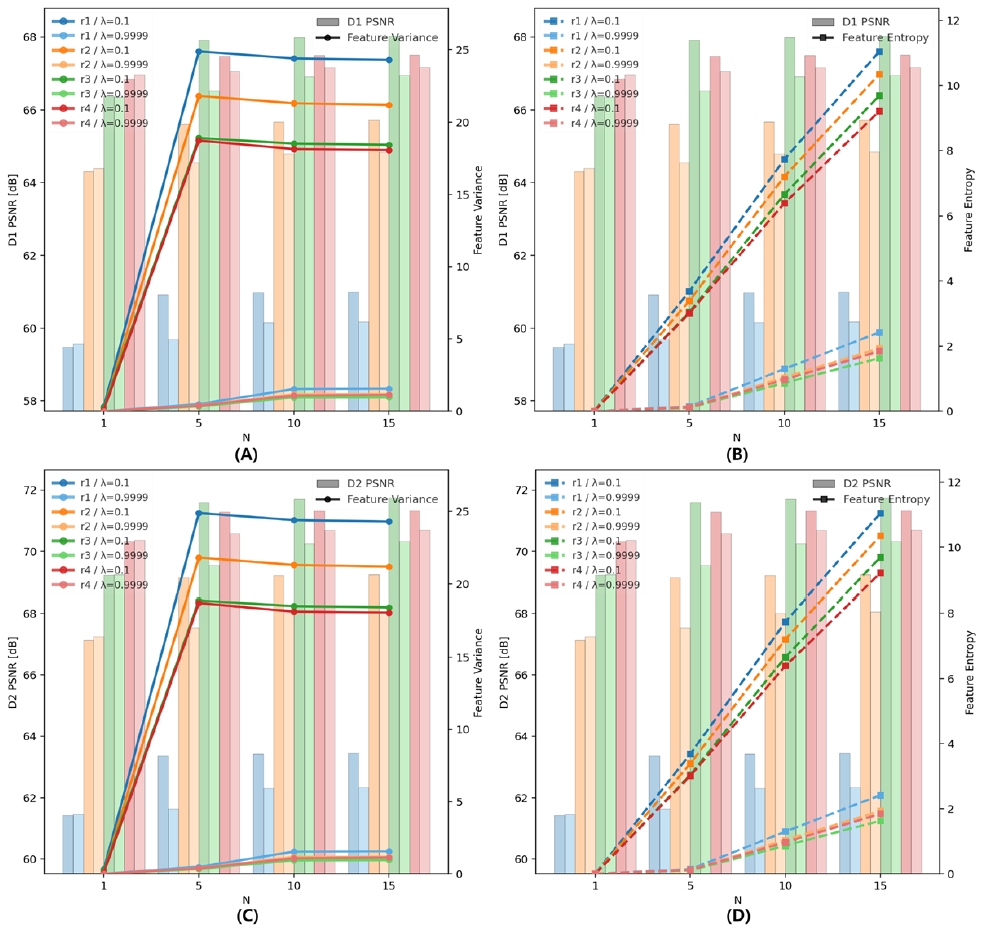

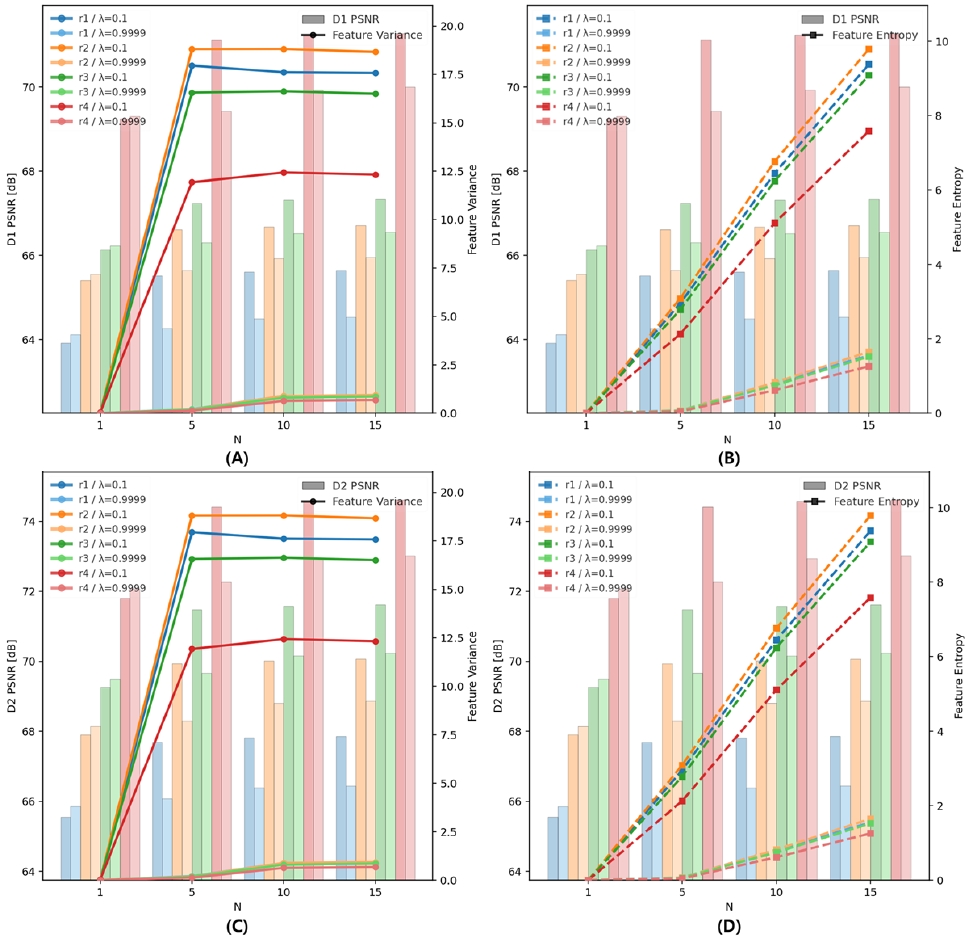

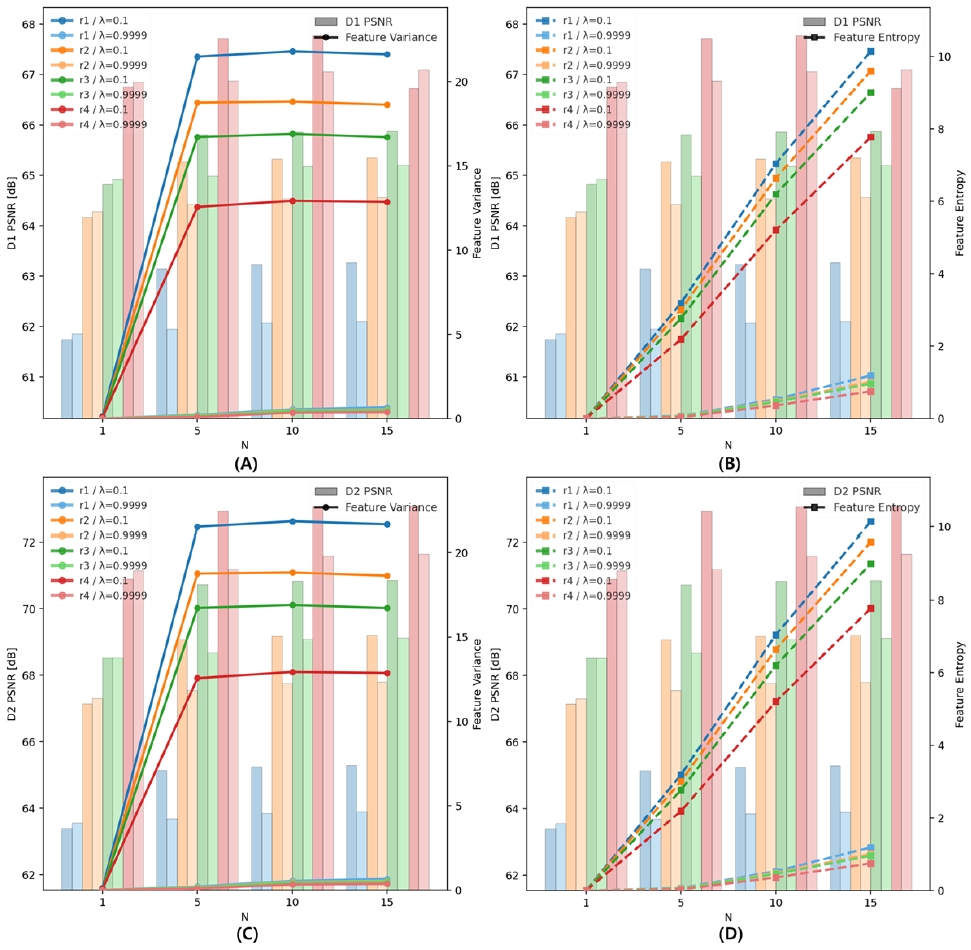

그림 12, 13, 14는 각각 RWTT_059_tomb_vox10, RWTT_156_vishnu_vox10, RWTT_211_foxstatue_vox10 시퀀스에 대한, 스케일링 수치에 따른 rate 및 lambda별 D1/D2 PSNR과 복호화된 특성 정보의 분산 및 엔트로피를 그래프로 표현한 것이다. 그림 14의 RWTT_211_foxstatue_vox10 시퀀스의 rate 4, 스케일링 수치 15에서의 D1 PSNR 결과를 제외한 그림 12, 13, 14의 모든 rate 및 lambda에 따른 실험 결과에서, 스케일링 수치가 증가할수록 D1/D2 PSNR은 증가하였다. 또한, 무손실 압축 환경의 결과에서 나타났던 점유 정보 비트스트림의 크기 비율에 대한 포화 현상이, D1/D2 PSNR에서도 관측되었다. 이는 앞선 분석과 유사하게, 특정 소수점 이하의 정밀도 및 표현력 향상이 더는 포인트의 복원 과정에 유의미한 영향을 미치지 못하여, D1/D2 PSNR 측면에서 효과가 제한되는 포화 구간이 관측되었다고 분석된다.

RWTT_059_tomb_vox10 sequence: (A) D1 PSNR and variance of decoded feature information depending on N; (B) D1 PSNR and entropy of decoded feature information depending on N; (C) D2 PSNR and variance of decoded feature information depending on N; (D) D2 PSNR and entropy of decoded feature information depending on N

RWTT_156_vishnu_vox10 sequence: (A) D1 PSNR and variance of decoded feature information depending on N; (B) D1 PSNR and entropy of decoded feature information depending on N; (C) D2 PSNR and variance of decoded feature information depending on N; (D) D2 PSNR and entropy of decoded feature information depending on N

RWTT_211_foxstatue_vox10 sequence: (A) D1 PSNR and variance of decoded feature information depending on N; (B) D1 PSNR and entropy of decoded feature information depending on N; (C) D2 PSNR and variance of decoded feature information depending on N; (D) D2 PSNR and entropy of decoded feature information depending on N

추가로 D1/D2 PSNR의 경우, lambda 값에 따른 PSNR 증가량의 변화가 관측되었다. 모든 RWTT 콘텐츠의 rate 결과에서, 0.1의 lambda 값이 사용되었을 때 PSNR 증가량이 0.9999의 lambda 값을 적용하였을 때의 PSNR 증가량보다 컸으며, 특히 15.0의 스케일링 수치에서 0.1의 lambda 값을 사용한 경우, D1, D2 PSNR은 평균적으로 1.27dB, 2.15dB만큼 증가하였다. 이러한 관측 결과는 0.1의 lambda 값에서의 복호화된 특성 정보의 분산 및 엔트로피 증가량이 0.9999 lambda 값에서의 증가량보다 크다는 사실과 연결되며, 본 논문에서 적용한 스케일링 기반 특성 정밀도 향상 방안이 포인트의 복원 과정도 보다 정확하게 수행하여 D1/D2 PSNR을 향상시킨 것으로 분석할 수 있다.

표 7과 8은 Static 콘텐츠에 대한 스케일링 수치에 따른 rate 및 lambda별 점유 및 특성 정보 비트스트림 크기 비율과 D1/D2 PSNR을 보여준다. 표 7에서, 점유 정보 비트스트림의 크기의 변화가 없는 것을 확인할 수 있다. 이를 통해 2 이하의 스케일링 수치가 복호화된 특성 정보의 분산 및 엔트로피를 증가시키지 못했고, 이에 점유 정보 비트스트림의 크기 또한 변화되지 않았다고 분석된다. 한편 2 이하의 스케일링 수치가 특성 정보에 변화를 주지 못했기 때문에, 특성 정보 비트스트림의 크기 증가 비율도, RWTT 콘텐츠 대비 매우 작은 것을 표 7을 통해 확인할 수 있다.

이러한 경향은 표 8의 Facade_00009_vox12 시퀀스의 rate 1에서도 관측된다. 이는, 더 작은 lambda 값을 사용하였음에도, 복호화된 특성 정보의 표현력을 증가시키지 못해, PSNR에서 향상이 발견되지 않은 것으로 판단된다. 또한, 표 8의 lambda 값이 1인 경우, PSNR의 어떤 변화도 관측되지 않았는데, 이는 매우 큰 lambda 값이 특성 정보의 값을 0에 가깝게 만들어, 2.0 이하의 스케일링 수치를 적용하여도 복호화된 특성 정보의 표현력을 향상시키지 못해, PSNR에 대한 변화를 만들어 내지 못한 것으로 예상된다.

Ⅴ. 결 론

본 논문에서는 표현력이 향상된 특성 정보가 포인트의 점유 여부에 대한 확률 예측 과정 또는 복원 과정에 얼마나 기여할 수 있는지를 분석하기 위해, 스케일링 기반 특성 정밀도 향상 방안을 표준 딥러닝 기반 포인트 클라우드 압축 모델인 TMAP에 적용하고, 이를 통해 표현력이 향상된 복호화된 특성 정보가 비트스트림 크기 및 PSNR과 같은 압축 지표에 미치는 영향을 실험적으로 분석하였다. 실험 결과를 통해, 스케일링 수치가 증가할수록 복호화된 특성 정보의 표현력이 향상되며, 향상된 표현력을 가지는 복호화된 특성 정보가 보다 정교한 포인트의 점유 정보에 대한 확률 예측 과정 및 복원 과정을 수행하여, 결과적으로 점유 정보에 대한 비트스트림 크기 감소와 PSNR 향상을 관측할 수 있었다. 이러한 점유 정보 비트스트림 크기 감소와 PSNR 향상을 위해서는 복호화된 특성 정보의 분산 및 엔트로피를 증가시킬 수 있는 일정 값 이상의 스케일링 수치가 사용되어야 하며, 동시에 특정 값 이상의 스케일링 수치에 대해서는 변화 폭이 매우 작은 포화 구간 또한 관측되었다. 추가로, 특성 정보 값을 조절할 수 있는 TMAP의 lambda 값에 따라, 적용 방법이 효능을 내지 못하는 구간의 존재도 확인할 수 있었다.

앞선 실험 결과 및 분석들을 통해, 본 논문의 향후 연구 방향은 스케일링 기반 특성 정밀도 향상 방안을 활용하여 압축 성능을 달성할 예정이다. 이에 대한 방안으로, 비트스트림 크기 감소 및 PSNR 향상은 복호화된 특성 정보의 분산 및 엔트로피가 증가한 경우에만 실현되기에, TMAP의 부호화 단에서 입력 특성 정보의 스케일링 및 양자화 과정 후 분산 및 엔트로피를 계산하여, 스케일링 기반 특성 정밀도 향상 방안을 선택적으로 적용하는 방안이 있다. 또한, 계층적인 분석을 기반으로, 특정 계층에만 스케일링 기반 특성 정밀도 향상 방안을 적용하는 방법도 계획 중이다. 다만 이러한 모든 방안은 특성 정보 비트스트림 크기 증가 비율, 점유 정보 비트스트림 감소 비율, PSNR 증가 비율 및 lambda 파라미터를 함께 고려하여 적절한 구간의 스케일링 수치를 찾는 과정이 동반되어야 한다. 한편 특성 정보 비트스트림 크기 증가 비율의 크기가 매우 크기에, 스케일링 기반 특성 정보 정밀도 향상 방안을 TMAP의 훈련 과정에 통합하여, 스케일링 된 특성 정보의 분포에 맞게 엔트로피 코딩 모듈을 최적화하는 연구도 진행될 예정이다. 이를 통해 특성 정보 비트스트림의 크기를 크게 증가시키지 않으면서, 점유 정보 비트스트림 크기 감소와 PSNR 향상을 통해 압축 성능을 높일 수 있을 것으로 기대한다.

Acknowledgments

이 논문의 결과 중 일부는 한국방송미디어공학회 2025년 하계학술대회에서 발표한 바 있음

이 논문은 2025년도 정부(과학기술정보통신부)의 재원으로 정보통신기획평가원의 지원을 받아 수행된 연구 (No.RS-2023-00227431, 3차원 공간 디지털미디어 규격화 기술 개발) 및 과학기술정보통신부 및 정보통신기획평가원의 대학ICT연구센터육성지원사업의 연구 결과로 수행되었음 (IITP-2025-RS-2021-II212046)

References

-

J. Zhou, H. Xu, Z. Ma, Y. Meng, and D. Hui, “Sparse Point Cloud Generation Based on Turntable 2D Lidar and Point Cloud Assembly in Augmented Reality Environment,” IEEE International Instrumentation and Measurement Technology Conference (I2MTC), Glasgow, United Kingdom, pp.1-6, 2021.

[https://doi.org/10.1109/I2MTC50364.2021.9459981]

-

S. Jia, X. Gong, F. Liu, and L. Ma, “AI-Powered LiDAR Point Cloud Understanding and Processing: An Updated Survey,” IEEE Transactions on Intelligent Transportation Systems, Vol.26, No.8, pp.11249-11275, August 2025.

[https://doi.org/10.1109/TITS.2025.3568500]

-

A. Wehr, and U. Lohr, “Airborne laser scanning—an introduction and overview,” ISPRS Journal of Photogrammetry and Remote Sensing, Vol.54, No.2-3, pp.68-82, July 1999.

[https://doi.org/10.1016/S0924-2716(99)00011-8]

-

K. Kim, B. Park, D. Kim, and Y. Seo, “Point Cloud Registration Algorithm Based on RGB-D Camera for Shooting Volumetric Objects,” Journal of Broadcast Engineering, Vol.24, No.5, pp.765-774, September 2019.

[https://doi.org/10.5909/JBE.2019.24.5.765]

-

T. Zong, Y. Mao, C. Li, Y. Liu, and Y. Wang, “Progressive Frame Patching for FoV-Based Point Cloud Video Streaming,” IEEE Transactions on Multimedia, Vol.27, pp.6154-6167, May 2025.

[https://doi.org/10.1109/TMM.2025.3565928]

- “V-PCC codec description”, ISO/IEC JTC1/SC29 WG7 3DG N00100, June, 2021.

-

Y. Hwang, J. Kim, and K. Kim, “2D Interpolation of 3D Points using Video-based Point Cloud Compression,” Journal of Broadcast Engineering, Vol.26, No.6, pp.692-703, November 2021.

[https://doi.org/10.5909/JBE.2021.26.6.692]

-

J. Kim, J. Im, S. Rhyu, and K. Kim, “3D Motion Estimation and Compensation Method for Video-Based Point Cloud Compression,” IEEE Access, Vol.8, pp.83538-83547, April 2020.

[https://doi.org/10.1109/ACCESS.2020.2991478]

- “G-PCC 2nd edition codec description”, ISO/IEC JTC1/SC29 WG7 3DG N00798, March, 2024.

-

J. Kim, S. Rhee, H. Kwon, and K. Kim, “LiDAR Point Cloud Compression by Vertically Placed Objects Based on Global Motion Prediction,” IEEE Access, Vol.10, pp.15298-15310, January 2022.

[https://doi.org/10.1109/ACCESS.2022.3148252]

- “Requirements for AI-based Point Cloud Coding”, ISO/IEC JTC1/SC29 WG2 MPEG N00358, May, 2024.

- “Use cases for AI-based Point Cloud Coding”, ISO/IEC JTC1/SC29 WG2 MPEG N00364, May, 2024.

- “Call for Proposals for AI-based Point Cloud Coding”, ISO/IEC JTC1/SC29 WG2 MPEG N00365, May, 2024.

- “Working draft of AI-based point cloud coding”, ISO/IEC JTC1/SC29 WG7 3DG N01257, August, 2025.

- “TMAP v1 for AI-based point cloud coding”, ISO/IEC JTC1/SC29 WG7 3DG N01124, February, 2025.

- J. Kwon, D. Kwon, S. Rhee, and K. Kim, “A Study on the Performance Analysis of Standard Deep Learning-based Point Cloud Compression using Feature Precision Enhancement,” 2025 The Korean Institute of Broadcast and Media Engineers Summer Conference, Jeju, Korea, pp.1436-1439, 2025.

-

D. Tian, H. Ochimizu, C. Feng, R. Cohen, and A. Vetro, “Geometric distortion metrics for point cloud compression,” 2017 IEEE International Conference on Image Processing (ICIP), Beijing, China, pp.3460-3464, 2017.

[https://doi.org/10.1109/ICIP.2017.8296925]

- M. A. Lodhi, J. Pang, J. Ahn, and D. Tian, “UniFHiD Part 1: InterDigital’s answer to MPEG AI-PCC for Track 1 Geometry-only”, ISO/IEC JTC1/SC29 WG7 3DG m70282, November, 2024.

- “CTC on AI-based point cloud coding”, ISO/IEC JTC1/SC29 WG7 3DG N01122, February, 2025.

-

C. E. Shannon, “A mathematical theory of communication,” The Bell System Technical Journal, Vol.27, No.3, pp.379-423, July 1948.

[https://doi.org/10.1002/j.1538-7305.1948.tb01338.x]

- 2024년 2월 : 경희대학교 우주과학과 이학사, 전자공학과 공학사

- 2024년 3월 ~ 현재 : 경희대학교 전자정보융합공학과 석사과정

- ORCID : https://orcid.org/0009-0003-8085-1170

- 주관심분야 : 포인트 클라우드 압축, 영상 처리, 멀티미디어 시스템

- 2024년 2월 : 경희대학교 전자공학과 공학사

- 2024년 3월 ~ 현재 : 경희대학교 전자정보융합공학과 석사과정

- ORCID : https://orcid.org/0009-0006-2150-4488

- 주관심분야 : 포인트 클라우드 압축, 영상 처리, 멀티미디어 시스템

- 1989년 2월 : 한양대학교 전자공학과 공학사

- 1996년 7월 : 영국 University of Newcastle upon Tyne 전기전자공학과 공학박사

- 1996년 ~ 1997년 : 영국 University of Sheffield, Research Fellow

- 1997년 ~ 2006년 : 한국전자통신연구원 대화형미디어연구팀장

- 2006년 ~ 현재 : 경희대학교 전자정보대학 교수

- ORCID : https://orcid.org/0000-0003-1553-936X

- 주관심분야 : 디지털 방송, 영상처리, 멀티미디어 통신, 디지털 대화형 방송