환경 변수 통합 기반의 네트워크 트래픽 예측을 위한 다변량 시계열 딥러닝 모델 비교에 관한 연구

Copyright © 2025 Korean Institute of Broadcast and Media Engineers. All rights reserved.

“This is an Open-Access article distributed under the terms of the Creative Commons BY-NC-ND (http://creativecommons.org/licenses/by-nc-nd/3.0) which permits unrestricted non-commercial use, distribution, and reproduction in any medium, provided the original work is properly cited and not altered.”

초록

최근 연구에서는 네트워크 트래픽이 날씨 조건이나 사용자 행동과 같은 다양한 외부 요인에 의해 영향을 받을 수 있으며, 이로 인해 과거 트래픽 데이터만으로는 정확한 예측을 달성하기 어렵다는 점이 강조되고 있다. 이러한 한계를 해결하기 위해 본 연구에서는 기상 정보와 같은 환경 변수를 통합하여 네트워크 트래픽 예측의 정확도를 향상시키는 다변량 시계열 예측 모델을 제안하였다. 본 연구에서는 RNN, GRU, LSTM, CNN, Transformer의 다섯 가지 딥러닝 모델을 동일한 실험 조건 하에서 평가하였다. 성능 평가는 MSE, RMSE, MAE, R², MAPE와 같은 지표를 사용하였으며, 모델 간 성능 차이의 통계적 유의성을 분석하기 위해 ANOVA와 Tukey HSD 사후 검정을 수행하였다. 또한, 각 환경 변수의 기여도를 분석하기 위해 Permutation Importance 기법을 적용하였으며, 이를 통해 환경 변수가 모델 성능에 유의미한 영향을 미친다는 사실이 입증되었다. 실험 결과, GRU와 RNN 모델이 전반적으로 가장 우수한 예측 정확도를 보였으며, 특히 온도와 일조시간과 같은 일부 기상 변수가 성능 향상에 긍정적인 영향을 미쳤다. 본 연구는 단순 순환 신경망(Recurrent Architecture)의 일반화 능력과 환경 변수를 통합하는 접근법의 효과성을 실증적으로 보여주었다. 또한 향후 연구 방향으로는 도메인 간 모델 적응(Cross-Domain Adaptation) 및 대형 언어 모델(LLM: Large Language Model)을 활용한 시계열 예측 프레임워크 적용 가능성을 제시한다.

Abstract

Recent studies have emphasized that network traffic can be influenced by various external factors such as weather conditions and user behavior, making it difficult to achieve accurate predictions using only historical traffic data. To address this limitation, this study proposes a multivariate time series prediction model that integrates environmental variables, such as meteorological information, to enhance the accuracy of network traffic forecasting. In this study, five deep learning models—RNN, GRU, LSTM, CNN, and Transformer—were evaluated under identical experimental conditions. The model performance was assessed using metrics such as MSE, RMSE, MAE, R², and MAPE, and statistical analyses including ANOVA and Tukey HSD post-hoc tests were conducted to examine the significance of performance differences among the models. In addition, the contribution of each environmental variable was analyzed using the Permutation Importance method, demonstrating that environmental factors have a significant impact on model performance. Experimental results showed that the GRU and RNN models achieved the highest overall prediction accuracy, while certain meteorological variables, such as temperature and sunlight duration, positively contributed to performance improvement. This study empirically demonstrates the generalization capability of simple recurrent architectures and the effectiveness of incorporating environmental variables into traffic prediction models. Furthermore, it suggests potential future research directions, including cross-domain model adaptation and the application of large language model (LLM)-based time series forecasting frameworks.

Keywords:

LLM, Deep Learning, ANOVA, Tukey HSD, Network Traffic PredictionⅠ. 서 론

초연결 사회의 도래와 함께 네트워크 인프라는 구조적 복잡성과 트래픽 처리 수요의 지속적인 증가를 겪고 있다. 5G의 상용화, 클라우드 및 엣지 컴퓨팅의 발전, 그리고 사물인터넷(IoT)의 확산으로 인해 네트워크에 연결된 장치의 수와 데이터 트래픽의 유형이 다양화되었다. 이에 따라 실시간 대규모 네트워크 트래픽 처리가 점점 더 중요한 과제로 부상하고 있다[1]. 이러한 상황에서 네트워크 트래픽의 폭증은 단순히 물리적 자원을 확충하는 것만으로는 효과적으로 대응할 수 없으며, 대신 지능형 네트워크 트래픽 예측 기반의 사전 자원 관리 시스템이 필요하다[2][3].

이에 따라 과거에는 ARIMA나 회귀분석과 같은 전통적인 통계 모델이 트래픽 예측에 활용되어 왔으나, 이러한 모델들은 실제 네트워크 트래픽의 복잡하고 비선형적인 패턴을 정확히 포착하는 데 한계를 보인다[4]. 최근에는 딥러닝을 활용한 시계열 예측 기법이 주목받고 있다. 특히 RNN(Recurrent Neural Network), LSTM(Long Short-Term Memory), GRU(Gated Recurrent Unit)와 같은 순환 신경망 기반 모델들은 시간적 종속성을 효과적으로 학습할 수 있는 구조로 인해 다양한 트래픽 예측 문제에 적용되고 있다.

그러나 이러한 순환 구조는 긴 시퀀스 입력을 학습하는 과정에서 기울기 소실 문제에 취약하며, 순차적 학습 방식으로 인해 병렬 처리가 비효율적이라는 구조적 한계를 지닌다. 이러한 한계를 극복하기 위해 최근에는 Transformer 기반 모델이 시계열 예측 분야로 확장되고 있다[5].

Transformer는 모든 시점 간의 관계를 동시에 고려하는 Self-Attention 메커니즘을 활용하여 장기 의존성이 존재하는 시계열 데이터에 효과적이다. 또한 순차적 연결을 제거한 병렬 처리 구조로 인해 학습 효율성이 크게 향상된다. 이러한 특성들은 자연어 처리 분야에서 이미 입증되었으며, 최근에는 시계열 예측을 위한 다양한 변형 구조들이 제안되고 있다[6].

딥러닝 기반 시계열 예측 연구는 최근 급속한 발전을 이루었으나, 네트워크 트래픽 예측에 적용할 때는 여전히 몇 가지 한계가 존재한다. 예를 들어, RNN 기반 모델(RNN, LSTM, GRU)은 시간적 종속성을 잘 포착하지만, 긴 시퀀스에서는 학습 속도가 느리고 기울기 소실 문제가 발생한다. CNN 기반 모델은 지역적 특징을 효율적으로 추출할 수 있지만 전역적 시간 의존성을 학습하는 데 한계가 있다. 반면 Transformer 기반 구조는 셀프 어텐션을 통해 장기 의존성 문제를 해결하지만, 소규모 혹은 노이즈가 많은 데이터셋에서는 계산 복잡도와 불안정성이 커지는 문제가 있다.

기존의 비교 연구들(예: Autoformer[7], Informer[8])은 ETTh, ETTm, PEMS 등의 벤치마크 데이터셋에서 모델의 정확도만을 평가했으며, 기상이나 환경적 요인 등 도메인 특화 외부 요인을 고려하지 않았다. 또한, 외생적 변수(예: 기상 정보)의 포함 여부가 모델 구조와 어떻게 상호작용을 하는지에 대한 분석도 부족하다. 그 결과, 실제 이기종 네트워크 환경에서 예측 정확도, 일반화 성능, 계산 효율성 간의 최적 균형을 달성하는 모델 유형에 대한 실증적 근거가 여전히 부족하다. 따라서 본 연구는 이러한 공백을 메우기 위해 다섯 가지 대표적인 딥러닝 모델(RNN, LSTM, GRU, CNN, Transformer)을 동일한 실험 조건에서 비교 분석하였다.

특히 각 모델이 환경 변수를 포함했을 때의 반응을 정량적으로 평가하고, ANOVA와 Tukey HSD 검정을 통해 통계적 유의성을 분석하였으며, Permutation Importance 기법을 활용하여 각 변수의 기여도를 측정하였다.

본 연구는 단순히 예측 정확도만을 다루는 기존 연구와 달리 모델 해석 가능성, 강건성, 그리고 성능 차이에 대한 구조적 근거에 초점을 맞추었다. 이러한 포괄적이고 통계적으로 검증된 비교 분석을 통해 실제 환경 인식형 네트워크 트래픽 예측에 적합한 각 모델 구조의 타당성에 대한 새로운 통찰을 제공한다. 한편, CNN 기반 모델은 원래 영상 인식 분야에서 사용되었지만, 최근에는 1차원 커널을 사용하여 시계열 데이터 내의 지역적 패턴을 추출하고 예측하는 데 효과적으로 활용되고 있다. CNN 기반 시계열 모델은 학습 파라미터 수가 적고 병렬 처리에 적합하며, 짧은 시간 구간 내에서 특징을 학습하는 데 유리하다. 이러한 특성 덕분에 갑작스러운 트래픽 변화나 단주기 예측에 특히 적합하다. 또한, 기존 연구의 또 다른 한계는 입력 변수의 구성에 있으며, 대부분의 연구는 과거 트래픽 사용량을 기반으로 트래픽을 예측하는 데 국한되어 있다. 그러나 실제 트래픽은 온도, 습도, 풍속, 일조량 등과 같은 환경 변수에 의해 영향을 받을 수 있다. 날씨 조건은 사람들의 온라인 활동, 산업 장비의 가동 시간, 네트워크 사용 패턴 등에 영향을 미칠 수 있으므로, 이러한 외부 정보를 통합한 다변량 예측 모델의 필요성이 대두된다. 하지만 모든 환경 변수가 예측 성능을 향상시키는 것은 아니다. 일부 변수는 잡음으로 작용하여 모델의 성능을 저하시킬 수 있다. 따라서 변수 선택 전략과 모델 구조 간의 상호작용을 정밀하게 분석할 필요가 있다.

본 연구에서는 한국남동발전의 실제 네트워크 트래픽 데이터를 기반으로 기상 데이터를 통합한 다변량 시계열 예측 모델을 구축하였다. RNN, LSTM, GRU, CNN, Transformer 모델을 동일한 조건에서 학습시켜 각 모델의 성능을 정량적으로 비교·분석하였다. 성능 평가는 MSE, RMSE, MAE, R², MAPE 등의 지표를 사용하여 환경 변수의 포함 여부에 따른 예측 성능의 차이를 분석하였고, Permutation Importance 기법을 적용하여 각 환경 변수의 기여도를 분석하고 본 논문에서 제안한 상관관계 기반 변수 선택의 타당성을 검증하였다. 이러한 분석을 통해 본 연구는 기존 시계열 예측 연구의 구조적 한계를 보완하고, Transformer 및 CNN 기반 모델의 실질적 적용 가능성을 실증적으로 제시하였다. 나아가 외부 환경 정보와 변수 선택 전략이 예측 정확도에 미치는 영향을 정량적으로 분석함으로써, 본 연구는 향후 지능형 네트워크 운용 시스템, 자율형 트래픽 제어 구조, 그리고 분산 인프라 관리 기술 설계에 실질적인 통찰을 제공하는데 기여할 수 있다.

Ⅱ. 관련 연구

1. 그래프 기반의 네트워크 트래픽 예측

그래프 기반 트래픽 예측 모델은 점점 더 동적인 시공간 관계를 학습하고, 시간에 따라 그래프 구조를 적응적으로 변화시키며, 빠르게 변화하는 네트워크 조건에서 노드 간 상호작용을 포착하는 방향으로 발전하고 있다[9-15]. 이러한 접근법은 도로 교통 흐름이나 셀룰러 기지국 간 협조와 같이, 공간적 토폴로지와 노드 간 의존성이 명확하고 시간에 따라 변화하는 영역에서 특히 효과적이다. 그러나 이러한 모델들은 일반적으로 조밀하고 명확하게 정의된 공간 그래프가 존재해야 하며, 도로 구조나 기지국 인접성과 같은 풍부한 공간적 맥락에 접근할 수 있어야 하고, 다수의 센싱 노드를 포함하는 대규모 지역 데이터셋이 존재한다는 가정을 전제로 한다.

하지만 이러한 전제는 네트워크 인프라 환경의 실제 통신 네트워크 운영 상황에서는 성립하지 않는다. 이 경우 트래픽 패턴은 사람의 이동성이나 도로 정체보다는 국소적 부하 조건 등에 의해 더 크게 영향을 받기 때문이다. 또한, 기존의 GNN 기반 연구들은 동일한 실험 조건에서 여러 딥러닝 모델을 아키텍처에 독립적으로 통제 비교하는 사례가 드물며, 외생 변수가 예측 정확도에 미치는 영향을 통계적으로 검증하는 연구도 거의 없다. 대표적인 그래프 기반 연구와 그 구조적 특성은 표 1에 요약되어 있다.

이에 반해, 본 연구는 명시적인 공간 그래프를 구성하거나 가정하지 않는다. 대신, 실제 SNMP(Simple Network Management Protocol) 기반 네트워크 트래픽 데이터를 사용하여 순환(RNN, GRU, LSTM), 합성곱(CNN), 그리고 어텐션 기반 Transformer 아키텍처를 동일한 학습 및 평가 파이프라인 하에서 비교 및 분석하였다. 특히, 온도, 풍속, 일조시간 등의 환경 변수를 통합함으로써 예측 정확도와 일반화 성능에 어떤 영향을 미치는지를 추가로 분석하였다.

이러한 설계는 새로운 공간 그래프 모델을 제안하는 것에서 벗어나, 환경 인식형 네트워크 트래픽 예측을 위한 해석 가능성, 통계적 검증과 실제 적용 가능성을 갖춘 체계를 제시하는 데 초점을 맞춘다.

2. 비그래프 기반 트래픽 예측

표 2에 요약된 바와 같이 비그래프 기반 트래픽 예측 연구들은 주로 기존 어텐션 메커니즘이 가진 확장성과 시퀀스 길이 제약을 극복하기 위해 Transformer 및 하이브리드 LSTM–Transformer 아키텍처를 발전시켜 왔다[16-20]. 이러한 접근법들은 시간적 구성 요소의 분해, 어텐션 희소성 개선, 다중 스케일 시간 인코더의 도입을 통해 장기 예측 성능을 크게 향상시켰다. 그러나 대부분의 연구들은 ETTh, ETTm, PEMS와 같은 대규모 공용 벤치마크 데이터셋을 기반으로 검증되었으며, 이들 데이터는 풍부하고 동질적이며 공간적으로 규칙적인 특성을 가진다. 따라서 이러한 연구들은 네트워크 트래픽의 동적 특성에 중요한 영향을 미칠 수 있는 외부 요인 또는 기상 변수를 거의 반영하지 못한다. 기존 연구들은 동일한 설정 하에서 여러 딥러닝 모델을 비교하고 그 결과를 통계적으로 검증한 사례가 거의 없으며, 이에 따라 모델 간 성능 차이가 실제 구조적 우월성에서 비롯된 것인지, 혹은 데이터셋 편향 때문인지를 명확히 판단하기 어렵다. 이에 반해 본 연구는 RNN, GRU, LSTM, CNN, Transformer 등 대표적인 딥러닝 아키텍처를 일관된 학습 및 평가 환경 하에서 비교할 수 있는 통제된 실험 프레임워크를 구축하여 새로운 Transformer 변형 모델을 제안하는 것이 아닌 해석 가능성, 재현성, 실용적 일반화에 초점을 맞추는 방법을 제안하고 검증하였다. 특히 본 연구는 온도, 풍속, 일조시간 등의 환경 요인이 각 모델 아키텍처와 어떻게 상호작용하는지를 분석하고, ANOVA 및 Tukey HSD 검정을 통해 그 영향을 정량적으로 검증하였다. 이러한 프레임워크는 모델 복잡도, 예측 정확도, 실제 배포 가능성 간의 상충 관계를 명확히 규명함으로써, 실제 산업 네트워크 트래픽 예측을 위한 투명하고 실증적인 비교 근거를 제공하고자 하였다.

3. 환경 정보 기반 트래픽 예측

표 3에 요약된 바와 같이, 최근의 환경 정보 기반 트래픽 예측 연구들은 실제 세계의 변동성을 보다 정밀하게 반영하기 위해 기상, 인프라 요인들을 딥러닝 프레임워크에 통합하려는 방향으로 발전해 왔다[21-24]. 이러한 연구들은 교통 흐름이 단순히 시간적 동역학이나 공간적 위상에 의해서만 결정되는 것이 아니라, 온도, 강수량, 습도, 주변 시설 등 다양한 외부 조건에 의해서도 크게 영향을 받는다는 점을 강조한다. 이를 달성하기 위해, 선행 연구들은 속성 확장, 선택적 어텐션, 동적 가중치 조정 등의 기법을 통해 기존 ST-GCN(Spatio-Temporal Graph Convolutional Network) 및 CNN–LSTM 하이브리드 모델을 확장하였다. 이러한 접근법은 모델이 비선형적이고 이질적인 외부 요인의 영향을 반영할 수 있도록 한다.

그러나 이러한 연구 대부분은 도시 교통 환경인 특히 도로망이나 지하철을 중심으로 설계되어 있으며, 이들 도메인에서는 공간 인접성과 물리적 노드 연결이 명확하게 정의되어 있다. 따라서 데이터 세분성, 위상적 정의, 외부 요인의 관련성이 상이한 비교통 도메인, 즉 산업 통신 네트워크에 대한 적용성은 여전히 불확실하다.

이에 반해, 본 연구는 산업 인프라 내 네트워크 트래픽에 초점을 맞춘다. 이 환경에서는 외부 환경 요인이 직접적인 물리적 이동성에 영향을 주기보다는 통신 행위에 간접적으로 영향을 미친다.

따라서 본 연구는 공간 그래프를 구성하거나 외부 속성을 GCN에 내재화하는 대신, 환경 변수를 독립적인 설명 변수로 분리하여 평가하였다. 특히, 온도, 풍속, 일조시간이 동일한 실험 조건에서 다양한 모델 아키텍처(RNN, GRU, LSTM, CNN, Transformer)의 예측 정확도에 어떤 영향을 미치는지를 체계적으로 분석하였다. 이 접근법은 환경 민감도와 모델 단순성 사이의 간극을 좁히며, 일반화 가능성과 운용 효율성을 아키텍처 복잡도보다 우선시한다. 따라서 본 연구는 실제 적용 가능한 실용적이고 신뢰성 있는 환경 인식형 트래픽 예측 모델을 구축하기 위한 실증적 근거를 제공한다.

Ⅲ. 연구 방법 및 실험 설계

본 연구의 목적은 실제 운영 데이터와 외부 환경 정보를 통합하여 시계열 기반 네트워크 트래픽 예측 모델의 성능을 평가하는 것이다. 또한, 다양한 딥러닝 아키텍처의 적용 가능성을 검증하는 것을 목표로 한다. 실험에 사용된 데이터는 한국남동발전에서 제공한 2년간의 SNMP(Simple Network Management Protocol) 기반 실제 네트워크 트래픽 로그로 구성되어 있으며, 이는 국내 주요 에너지 공기업의 실제 운영 환경을 반영한다.

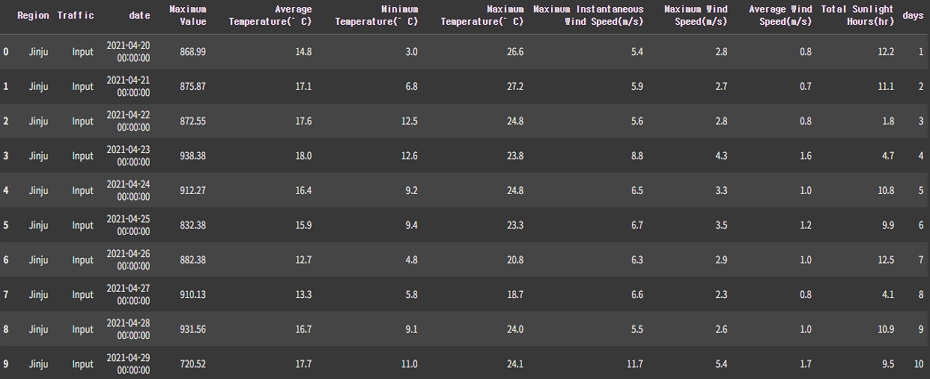

해당 데이터셋은 고압 변전소 통신망 환경을 기반으로 하며, 그 구조는 그림 1에 제시되어 있다.

시간 단위로 측정된 트래픽 데이터 중에서 일별 최대 트래픽 값을 예측 대상으로 설정하였다. 이는 네트워크 인프라 설계 및 용량 계획에 있어 핵심적인 지표로 활용된다.

1. 학습 데이터 구성

본 연구에서의 예측 대상은 초당 메가비트(Mbps) 단위로 측정된 일별 최대 네트워크 트래픽 값이며, 이는 시간 단위로 수집된 SNMP 로그로부터 산출되었다. 입력 변수는 네트워크 관련 변수와 환경 변수의 두 범주로 구성되어 있으며, 이를 통해 내부 시계열적 경향과 외부 환경적 영향을 포괄적으로 반영할 수 있도록 설계되었다. 구체적으로, 네트워크 관련 변수는 이전 7일간의 트래픽 이력을 포함하고, 환경 변수는 평균 기온, 최저 기온, 최고 기온, 평균 풍속, 최대 풍속, 순간 최대 풍속, 총 일조시간으로 7개 요소로 구성되었다.

따라서 각 입력 샘플은 7일간의 시퀀스 내에서 8차원 다변량 특성 벡터를 구성하며, 모델은 다음 날의 트래픽 값을 예측하도록 학습된다. 이러한 구성은 모델이 네트워크 동작의 단기 시계열 의존성과 기상 요인의 맥락적 영향을 동시에 학습할 수 있도록 하여 예측 정확도와 해석 가능성을 모두 향상시킨다. 또한, 재현성 및 투명성을 보장하기 위해 데이터셋의 세부 특성은 아래와 같이 요약된다.

모든 입력 변수는 Min–Max 정규화 기법을 사용하여 [0, 1] 범위로 정규화되었으며, 이를 통해 변수 간의 수치적 크기 차이를 일관되게 유지하였다. 정규화 이후, 결측값과 이상치는 표준 데이터 정제 파이프라인을 통해 식별 및 보정되었으며, 이를 통해 전체 데이터 품질이 향상되고 모델의 안정적인 수렴이 보장되었다. 정규화(Min–Max, [0,1])는 학습 데이터에서 스케일러 파라미터(최솟값/최댓값)를 추정한 후, 해당 파라미터를 검증 및 학습 데이터에 사용하였으며, 이는 학습데이터의 학습 유입(data leakage)을 방지하기 위함이다. 전처리가 완료된 후, 시계열 데이터셋은 시간 순서를 유지한 상태에서 훈련 60%, 검증 20%, 테스트 20% 비율로 분할되었다. 이는 데이터 누수를 방지하고 시계열의 시간적 순서를 보존하기 위함이다. 이후 학습 샘플은 슬라이딩 윈도우 구조로 구성되어, 7일간의 입력 시퀀스를 기반으로 다음 날의 최대 트래픽 값을 예측하도록 설계되었다.

이러한 순차적 구성은 모델이 단기 시계열 의존성을 효과적으로 학습하면서, 데이터셋의 내재적 연속성을 유지할 수 있도록 한다.

2. 모델 아키텍처 및 설정

데이터 전처리 후, 본 연구에서는 시계열 데이터의 복잡한 패턴을 효과적으로 학습하기 위해 다섯 가지 딥러닝 모델을 비교 대상으로 선정하였다. 선정된 모델은 순환 신경망(Recurrent Neural Network, RNN), 장단기 메모리 네트워크(Long Short-Term Memory, LSTM), 게이트 순환 유닛(Gated Recurrent Unit, GRU), 합성곱 신경망(Convolutional Neural Network, CNN), 그리고 Transformer이다.

이들 모델은 시간적·공간적 정보를 학습하는 방식과 구조적 특성에서 차이를 보이고 있으며, 훈련과 평가는 일관된 실험 조건에서 수행되었고, 이를 통해 각 모델의 예측 성능과 구조적 해석 가능성을 비교하였다. RNN은 기본적인 순환 구조를 통해 단기 의존성을 학습하는 데 적합하지만, 긴 시퀀스에서 정보를 유지하는 데 한계를 가진다. LSTM은 게이트 구조를 도입하여 RNN의 장기 기억 손실 문제를 해결하고, 장기 의존성 학습에 특화되어 있다. GRU는 LSTM보다 단순한 구조를 가지며, 계산 효율성과 예측 성능 간의 균형을 제공한다. CNN은 시계열 데이터를 1차원 이미지로 간주하여 시간 축을 따라 국소 패턴을 효과적으로 추출하며, 병렬 연산이 가능하고 계산 비용이 낮다. Transformer는 Self-Attention 메커니즘을 기반으로 전체 시퀀스를 동시에 고려할 수 있어 장기 의존성을 효과적으로 모델링할 수 있다. 이는 시계열 예측 분야에서 우수한 성능을 보여주며, 최근 다양한 응용 연구에 적극 활용되고 있다.

각 모델은 동일한 입력 구조를 사용하여 학습되었으며, 주요 하이퍼파라미터는 표 5에 정리되어 있다. 변수 선택은 상관관계 분석을 기반으로 수행하였으며, 전채 환경 변수를 포함한 경우(Included)와 제외한 경우(Excluded)를 비교하여 환경 정보의 유효성을 분석하였다. 또한, 순열 기반 중요도 기반으로 변수별 기여도를 평가하고, 상관성이 낮은 변수를 제거하여 재학습하는 실험을 추가로 구성하였다.

모델 학습 시 과적합을 방지하기 위해 검증 데이터셋의 손실 개선이 정체될 경우 학습을 조기 종료하였으며, 공정한 비교를 위해 모든 실험은 동일한 초기 설정값과 네트워크 구조를 유지하였다. 외부 요인의 영향은 Permutation Importance 기법을 사용하여 평가되었다. 이 방법은 각 변수의 값을 무작위로 섞은 후 모델의 성능 변화 즉, MSE(Mean Squared Error) 증가량을 관찰함으로써, 각 변수의 상대적 중요도를 정량적으로 산출하였다. 이와 더불어 예측값과 실제값의 절대 차이를 평균한 값인 MAE (Mean Absolute Error)와 MSE의 제곱근으로 실제 오차 단위와 동일하며 큰 오차에 민감한 RMSE(Root Mean Squared Error)와 모델이 실제 값을 얼마나 잘 설명하는지 나타내는 지표로 1에 가까울수록 성능의 우수함을 나타내는 R²(Coefficient of Determination) 방식과 예측 오차를 실제값 대비 백분율로 표현하여 상대적 정확도 평가에 유용한 MAPE(Mean Absolute Percentage Error) 방식을 사용하였다.

Ⅳ. 실험 결과 및 분석

1. 딥러닝 기반 예측 모델의 성능 분석

GRU, RNN, LSTM, CNN, Transformer의 다섯 가지 딥러닝 모델을 동일한 조건에서 비교하여 시계열 기반 네트워크 트래픽 예측의 성능을 분석하였다. 실험에서는 외부 환경 변수를 제외하고, 입력 특성으로 최대 트래픽 값만을 사용하였다.

학습 에포크 수는 100에서 1000까지 100 단위로 증가시켰으며, 배치 크기는 7, 14, 21로 설정하여 총 150회의 실험을 수행하였다. 모든 모델은 동일한 실험 조건에서 실험이 진행되었으며, 손실 함수는 평균제곱오차, 최적화 알고리즘은 Adam, 활성화 함수는 tanh를 사용하여 각 모델의 예측 정확도와 구조적 특성을 기준으로 비교·분석하였다. 그 결과 표 6에서 나타난 것처럼 GRU는 Epoch가 1000, Batch Size가 7인 경우 MSE가 3400.24로 가장 낮았다.

표 6의 결과는 전체 모델 중 RNN이 가장 낮은 MSE 값을 기록하여, 동등한 조건 하에서 가장 안정적인 예측 성능을 달성했음을 시사한다.

이러한 결과는 순환 구조, 특히 RNN과 GRU가 LSTM, CNN 및 Transformer와 같은 복잡한 구조보다 네트워크 트래픽 예측에서 더 우수한 성능을 발휘함을 실증적으로 보여준다. 그중에서도 RNN은 모든 실험 조건에서 가장 안정적이고 재현 가능한 성능을 보였으며, 하이퍼파라미터 변화에 대한 민감도가 낮고 평균 MSE와 MAE가 가장 낮은 값을 기록하였다.

반면 GRU는 특정 설정에서 RNN과 유사하거나 약간 더 낮은 최소 오차를 달성하기도 했으나, 일관된 결과를 유지하기 위해서는 보다 세밀한 하이퍼파라미터 튜닝이 요구됨을 알 수 있었다.

따라서 본 연구에서는 RNN을 실제 환경에서의 배포에 가장 적합한 모델로 확인하였으며, 이는 예측 정확도, 계산 효율성, 그리고 구현 단순성 간의 최적의 균형을 제공하는 모델로 평가된다.

2. 환경 변수 기반의 모델 간 성능 차이 및 통계적 유의성 검증

딥러닝 기반 예측 모델(GRU, RNN, LSTM, CNN, Transformer) 간의 성능 차이를 통계적으로 분석하기 위해서 각 모델에서 산출된 평균제곱오차(Mean Squared Error, MSE) 값을 기반으로 정규성 검정과 분산분석(ANOVA: Analysis of Variance)을 수행하였다. 먼저, 각 모델의 MSE 데이터가 정규 분포를 따르는지를 확인하기 위해 Shapiro–Wilk 정규성 검정(Shapiro–Wilk test)을 적용하였고, 그 결과는 표 7에 제시되어 있다. 정규성 검정 결과, 환경 변수가 포함되지 않은 조건에서는 대부분의 모델이 정규성을 만족하였으나, RNN과 Transformer는 유의 수준 0.05에서 정규성을 만족하지 않았다. 반면, 모든 환경 변수가 포함된 조건에서는 CNN만이 정규성을 충족하였다. 다만, Shapiro–Wilk 검정은 표본 크기가 작을 경우 민감하게 반응할 수 있으며, ANOVA는 정규성 위반에 대해서 비교적 강건한 통계 기법으로 알려져 있기 때문에 모델에 따라, 모델 간 평균 차이를 추가로 평가하기 위해 일원 분산분석(One-Way ANOVA)을 수행하였다. 그 결과, p-value < 0.001 수준에서 딥러닝 기반 예측 모델 간의 MSE 차이가 통계적으로 유의미함이 확인되었다. 이후, Tukey의 HSD (Honestly Significant Difference) 사후 검정을 수행하였으며, 그 결과는 표 8에 제시되어 있으며, 주요 모델 간의 통계적 차이를 명확히 보여준다.

Results of Tukey HSD Post-hoc Test for Pairwise MSE Differences Across Deep Learning Models Under Various Environmental Input Conditions

GRU와 CNN 간의 평균 MSE 차이는 -2028.58로 나타났으며, 이는 p = 0.0123 수준에서 통계적으로 유의미하였다. RNN과 CNN 간의 평균 MSE 차이는 -6071.34로 p = 0.0472 수준에서 유의미한 차이를 보였다. 또한, LSTM과 CNN, 그리고 Transformer와 CNN 간의 비교에서도 p < 0.05 수준에서 통계적으로 유의한 성능 차이가 관찰되었다. 이러한 결과는 상대적으로 단순한 순환 신경망 기반 모델(RNN, GRU)이 CNN이나 Transformer와 같은 복잡한 구조의 모델보다 MSE 기준 예측 성능에서 통계적으로 우수함을 보여준다.

특히 RNN은 평균적인 성능뿐만 아니라 성능의 일관성, 즉 변동성 측면에서도 매우 우수한 결과를 나타냈으며, 이는 단순한 순환 구조가 시계열 예측 문제에 효과적으로 적용될 수 있음을 시사한다.

3. 환경 변수 통합에 따른 예측 성능 변화 분석

환경 정보를 딥러닝 기반 시계열 예측 모델에 통합하는 것은 모델 구조에 따라 성능을 크게 향상 또는 저하할 수 있다. 이는 환경 변수 간의 상관관계가 낮거나 혹은 불필요한 정보 학습으로 이어질 수 있음을 의미하며, 표 9의 실험 결과에서도 확인할 수 있었다. 예를 들어, GRU 모델의 경우 환경 정보를 포함하지 않았을 때 평균 MSE는 7009.41로 높았으나, 환경 변수를 통합한 후에는 1151.46으로 급격히 감소하였다. MAE와 RMSE 또한 각각 54.48에서 25.05로 감소하였다. RNN 구조에서는 환경 변수의 도입이 가장 긍정적인 영향을 미쳤다. MSE는 2966.65에서 407.3으로 일관된 성능 향상을 보였다.

Prediction Performance Comparison for GRU, LSTM, RNN, CNN, and Transformer Models with and without Environmental Information

반면, LSTM 모델은 평균 MSE가 7300.25에서 1394.28로 감소하는 일부 지표에서 개선이 있었으나, 0.99로 제한적이었다. 또한 일부 실험 조건에서는 성능 변동성이 나타나, LSTM이 장기 의존성 학습에는 강하지만, 환경 변수와 같은 단기적 외부 요인을 통합하는 데에는 다소 약할 수 있음을 보여준다. 따라서, 모든 모델에 외부 변수를 일괄 적용하기보다는, 모델 구조와 입력 특성 간의 상호작용을 고려하여 환경 변수 활용이 필요함을 확인하였다.

4. 환경 변수를 포함한 모델별 최적 조건 성능 비교

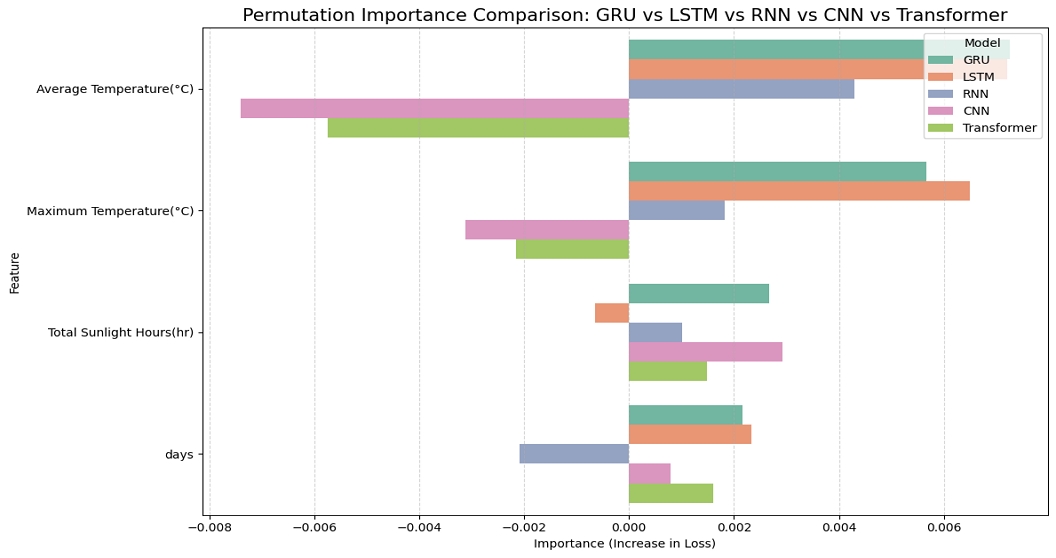

Permutation Importance 기법을 적용하여 다섯 가지 딥러닝 모델(RNN, LSTM, GRU, CNN, Transformer)에서 각 입력 특성이 예측 성능에 기여하는 정도를 정량적으로 평가하였다.

모든 실험은 동일한 하이퍼파라미터 설정(Epoch = 1000, Batch Size = 7) 하에서 수행되었으며, 입력 변수로는 최대 트래픽 값, 평균 온도, 최고 온도 및 일조량이다. Permutation Importance는 각 변수의 값을 무작위로 섞어 해당 변수와 목표 변수(target) 간의 연관성을 인위적으로 끊고, 그 결과 모델의 예측 성능이 어떻게 변화하는지를 측정함으로써 각 변수의 상대적 중요도를 추정하는 기법이다.

변수 중요도 점수가 높을수록 해당 변수가 모델의 정확도 향상에 더 크게 기여함을 의미하며, 반대로 낮거나 음수의 점수는 그 변수가 모델 성능에 거의 기여하지 않거나 심지어 성능에 부정적인 영향을 미칠 수 있음을 나타낸다.

그림 2는 다섯 가지 모델 간 환경 변수의 Permutation Importance를 비교한 것이다. 전반적으로 평균 온도와 최대 온도는 대부분의 모델에서 상대적으로 높은 중요도를 보였다. 특히 RNN과 GRU 모델에서는 최대 온도가 가장 영향력 있는 특성으로 확인되었으며, 이는 두 모델이 온도 관련 변수의 시간적 변동을 효과적으로 포착한다는 것을 보여준다.

Permutation Importance Comparison of Environmental Variables Across GRU, LSTM, RNN, CNN, and Transformer Models

LSTM 모델의 경우, 네 가지 변수 모두 상대적으로 낮은 중요도 점수를 보였으며, 이러한 현상은 LSTM이 장기 의존성을 학습하도록 구조적으로 최적화되어 있기 때문에, 환경 조건의 단기적 변화를 효과적으로 활용하는 데 한계가 있었기 때문으로 해석될 수 있다. 반대로, GRU와 RNN 모델은 구조적으로 단기 변화에 더 민감하기 때문에, 일조시간이나 온도 시계열과 같은 변수들에서 보다 뚜렷한 예측 기여도를 보였음을 알 수 있다.

Ⅴ. 결 론

본 연구에서는 GRU, RNN, LSTM, CNN, Transformer의 다섯 가지 딥러닝 기반 시계열 예측 모델을 대상으로, 하이퍼파라미터 설정의 변화, 환경 변수의 포함 여부, 특성 선택(feature selection) 전략 등 다양한 조건에서의 성능을 정량적으로 비교하였다. 실험 결과, 상대적으로 단순한 순환 구조를 사용하는 RNN과 GRU 모델이 항상 우수한 예측 정확도와 안정성을 보였다.

특히, 환경 정보를 선택적으로 통합했을 때 두 모델의 성능이 더욱 향상되었음을 확인할 수 있었으며, 복잡한 구조를 가진 CNN과 Transformer 모델은 시간적 특성을 학습하는 데 한계를 보였다. 또한, 일부 변수에서 음수의 Permutation Importance 점수가 관찰되었는데, 이는 해당 모델들 내에 정보적 노이즈가 존재함을 시사한다.

GRU와 RNN 모델의 우수한 성능은 데이터셋의 특성과 구조적 특성이 잘 일치하기 때문으로 설명할 수 있다. 두 모델 모두 단기적인 시간 의존성과 순차적 연속성을 포착하는 데 최적화되어 있으며, 이는 일 단위 네트워크 트래픽의 변동성을 설명하는 주요 요인이다. 특히, GRU는 LSTM보다 단순화된 게이팅 메커니즘을 사용하기 때문에, 상대적으로 작은 규모의 데이터에서도 효율적인 파라미터 갱신이 가능하고, 과적합을 방지하며 빠른 수렴과 안정적인 일반화를 달성할 수 있음을 확인하였다.

반면, CNN과 Transformer 모델은 이번 실험 환경에서 구조적 강점을 충분히 발휘하지 못했다. CNN의 합성곱 필터는 지역적 시간 패턴을 효과적으로 추출하지만, 순환 구조가 없기 때문에 장기적인 시간 의존성을 유지하기 어렵다.

Transformer는 이론적으로 장기 시퀀스를 모델링하는데 강력하지만, 짧은 시퀀스 데이터 규모가 제한된 경우에는 과적합되거나 학습 불안정성을 보이는 경향이 있을 수 있다. 또한, 어텐션 기반 모델들은 상관관계가 약하거나 노이즈가 많은 환경 변수에 더 민감하게 반응하므로, 이는 일부 변수에서 관찰된 음수 Permutation Importance 값을 설명할 수 있다.

이러한 결과를 종합하면, 데이터 규모가 중간 수준이고, 예측 기간이 짧은 경우, GRU와 RNN과 같은 순환 구조가 시간적 표현 능력, 계산 효율성, 환경적 변동성에 대한 강건성 사이에서 가장 우수한 균형을 달성함을 알 수 있다. 또한, Shapiro–Wilk 정규성 검정(normality test), 일원 분산분석(One-Way ANOVA), Tukey HSD 사후 검정을 활용한 통계적 검증 결과, 모델 간 성능 차이는 통계적으로 유의미함이 확인되었으며 확인된 수치적 차이가 단순한 우연이 아님을 입증하였다.

향후 연구에서는 추론 지연 시간, 처리량, 에너지 소비량 등을 다양한 플랫폼에서 벤치마킹하여, 엣지 컴퓨팅 및 실시간 네트워크 모니터링 시스템 환경에서의 모델 배포 가능성을 평가해야 할 것이다. 또한, Batch Size를 (7/14/21/28)로 좀 더 세분화하고 각 각의 Batch Size 기준의 지연(Lag), 입력 피처 수 확장 및 캘린더 변수(요일·주차·공휴일 등)를 포함하여 추가 실험을 통해 Batch Size 변화에 따른 시계열 의존성 학습 효과, 변수 구성에 따른 모델의 일반화 능력, 그리고 계절성·주기성 요인이 네트워크 트래픽 예측 정확도에 미치는 영향을 정량적으로 평가할 필요가 있다.

References

-

Gao, Z., 5G traffic prediction based on deep learning, Computational Intelligence and Neuroscience, Vol. 2022, No. 1, 2022.

[https://doi.org/10.1155/2022/3174530]

-

Harir, M. A. N., Ataro, E., Nyah, C. T., Machine Learning-Based Fifth-Generation Network Traffic Prediction Using Federated Learning, International Journal of Advanced Computer Science & Applications, Vol. 16, No. 1, 2025.

[https://doi.org/10.14569/ijacsa.2025.0160130]

-

Xu, L., Liu, H., Song, J., Li, R., Hu, Y., Zhou, X., Patras, P., TransMUSE: Transferable traffic prediction in multi-service edge networks, Computer Networks, Vol. 221, 2023.

[https://doi.org/10.1016/j.comnet.2022.109518]

-

Bousqaoui, H., Slimani, I., Achchab, S., Comparative analysis of short-term demand predicting models using ARIMA and deep learning, International Journal of Electrical and Computer Engineering, Vol. 11, No. 4, 2021.

[https://doi.org/10.11591/ijece.v11i4.pp3319-3328]

-

Zerveas, G., Jayaraman, S., Patel, D., Bhamidipaty, A., Eickhoff, C., A Transformer-based Framework for Multivariate Time Series Representation Learning, KDD '21: Proceedings of the 27th ACM SIGKDD Conference on Knowledge Discovery & Data Mining, 2021.

[https://doi.org/10.1145/3447548.3467401]

-

Zhou, H., Zhang, S., Peng, J., Zhang, S., Li, J., Xiong, H., Zhang, W., Informer: Beyond Efficient Transformer for Long Sequence Time-Series Forecasting, Proceedings of the AAAI Conference on Artificial Intelligence, Vol. 35, No. 12, 2021.

[https://doi.org/10.1609/aaai.v35i12.17325]

-

Wu, H., Xu, J., Wang, J., Long, M., Autoformer: Decomposition transformers with auto-correlation for long-term series forecasting, Advances in neural information processing systems, Vol. 34, 2021.

[https://doi.org/10.48550/arXiv.2106.13008]

-

Zhao, B., Lu, H., Chen, S., Liu, J., Wu, D., Convolutional neural networks for time series classification, Journal of systems engineering and electronics, Vol. 28, No. 1, 2017.

[https://doi.org/10.21629/JSEE.2017.01.18]

- Lan, S., Ma, Y., Huang, W., Wang, W., Yang, H., Li, P., DSTAGNN: Dynamic Spatial-Temporal Aware Graph Neural Network for Traffic Flow Forecasting, In International Conference on Machine Learning, Vol. 162, 2022.

-

Tian, C., & Chan, W. K., Spatial‐temporal attention wavenet: A deep learning framework for traffic prediction considering spatial‐temporal dependencies, IET Intelligent Transport Systems, Vol. 15, No. 4, 2021.

[https://doi.org/10.1049/itr2.12044]

-

Wang, Z., Hu, J., Min, G., Zhao, Z., Chang, Z., Wang, Z., Spatial-temporal cellular traffic prediction for 5G and beyond: A graph neural networks-based approach, IEEE Transactions on Industrial Informatics, Vol. 19, No. 4, 2022.

[https://doi.org/10.1109/TII.2022.3182768]

-

Liu, A., & Zhang, Y., Spatial–Temporal Dynamic Graph Convolutional Network With Interactive Learning for Traffic Forecasting, IEEE Transactions on Intelligent Transportation Systems, Vol. 25, No. 7, 2024.

[https://doi.org/10.1109/TITS.2024.3362145]

-

Ji, J., Wang, J., Huang, C., Wu, J., Xu, B., Wu, Z., Zhang, J., Zheng, Y., Spatio-temporal self-supervised learning for traffic flow prediction, In Proceedings of the AAAI conference on artificial intelligence, Vol. 37, No. 4, 2023.

[https://doi.org/10.1609/aaai.v37i4.25555]

-

Yao, Z., Xia, S., Li, Y., Wu, G., Zuo, L., Transfer learning with spatial–temporal graph convolutional network for traffic prediction, IEEE Transactions on Intelligent Transportation Systems, Vol. 24, No. 8, 2023.

[https://doi.org/10.1109/TITS.2023.3250424]

-

Aouedi, O., Le, V. A., Piamrat, K., Ji, Y., Deep learning on network traffic prediction: Recent advances, analysis, and future directions, ACM Computing Surveys, Vol. 57, No. 6, 2025.

[https://doi.org/10.1145/3703447]

-

Wu, H., Xu, J., Wang, J., Long, M., Autoformer: Decomposition transformers with auto-correlation for long-term series forecasting, Advances in neural information processing systems, Vol. 34, 2021.

[https://doi.org/10.48550/arXiv.2106.13008]

-

Zhou, H., Zhang, S., Peng, J., Zhang, S., Li, J., Xiong, H., Zhang, W., Informer: Beyond efficient transformer for long sequence time-series forecasting, In Proceedings of the AAAI conference on artificial intelligence, Vol. 35, No. 12, 2021.

[https://doi.org/10.48550/arXiv.2012.07436]

-

Luo, Q., He, S., Han, X., Wang, Y., Li, H., LSTTN: A long-short term transformer-based spatiotemporal neural network for traffic flow forecasting, Knowledge-Based Systems, Vol. 293, 2024.

[https://doi.org/10.1016/j.knosys.2024.111637]

-

Dong, X., Zhao, W., Han, H., Zhu, Z., Zhang, H., MTESformer: Multi-scale temporal and enhance spatial transformer for traffic flow prediction, IEEE Access, Vol. 12, 2024.

[https://doi.org/10.1109/ACCESS.2024.3381987]

-

Yan, X., Gan, X., Tang, J., Zhang, D., Wang, R., ProSTformer: Progressive space-time self-attention model for short-term traffic flow forecasting, IEEE Transactions on Intelligent Transportation Systems, Vol. 25, No. 9, 2024.

[https://doi.org/10.1109/TITS.2024.3367754]

-

Shi, B., Wang, Z., Yan, J., Yang, Q., Yang, N., A Novel Spatial–Temporal Deep Learning Method for Metro Flow Prediction Considering External Factors and Periodicity, Applied Sciences, Vol. 14, No. 5, 2024.

[https://doi.org/10.3390/app14051949]

-

Zhu, J., Wang, Q., Tao, C., Deng, H., Zhao, L., Li, H., AST-GCN: Attribute-augmented spatiotemporal graph convolutional network for traffic forecasting, IEEE Access, Vol. 9, 2021.

[https://doi.org/10.1109/ACCESS.2021.3062114]

-

Nadarajan, J., Sivanraj, R., Attention-based multiscale spatiotemporal network for traffic forecast with fusion of external factors, ISPRS International Journal of Geo-Information, Vol. 11, No, 12, 2022.

[https://doi.org/10.3390/ijgi11120619]

-

Ye, J., Xue, S., Jiang, A., Attention-based spatio-temporal graph convolutional network considering external factors for multi-step traffic flow prediction, Digital Communications and Networks, Vol. 8, No. 3, 2022.

[https://doi.org/10.1016/j.dcan.2021.09.007]

- 2001년 : 호서대학교 기계학과(공학사)

- 2003년 : 경희대학교 정보통신대학원 정보통신망관리공학과(공학석사)

- 2007년 : 경희대학교 대학원 컴퓨터공학과(박사수료)

- 2024년 ~ 현재 : 경희대학교 컴퓨터공학과 겸임교수

- ORCID : https://orcid.org/0009-0006-4194-7585

- 주관심분야 : 네트워크, 네트워크 보안 및 IoT, 가상화 컴퓨팅, 인공지능

- 1987년 : 연세대학교 전자공학과(공학사)

- 1989년 : 연세대학교 전자공학과(공학석사)

- 1994년 : 연세대학교 전자공학과(공학박사)

- 1997년 : The Univ. of Tokyo 정보통신(Ph.D.)

- 1999년 ~ 현재 : 경희대학교 컴퓨터공학과 교수

- 2007년 ~ 현재 : Cisco Networking Academy 센터장

- ORCID : https://orcid.org/0000-0001-6630-1189

- 주관심분야 : 사이버 보안, 사물인터넷, 인공지능